Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 27.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

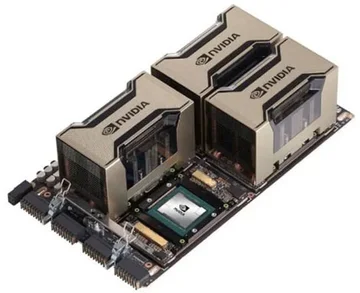

Видеокарта NVIDIA A100X 80GB HBM2e

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA A100X 80GB HBM2e

Лицензии

Описание

NVIDIA A100X 80 GB HBM2e — это тензорный ускоритель семейства NVIDIA A100, ориентированный на работу в дата-центрах и высокопроизводительных вычислительных платформах для задач искусственного интеллекта, аналитики данных и HPC. Ускоритель построен на архитектуре NVIDIA Ampere и оснащен 80 ГБ памяти HBM2e с пропускной способностью более 2 ТБ/с, что обеспечивает высокую производительность при работе с крупными моделями и массивами данных, характерными для современных AI‑и научно‑технических задач. Встроенные тензорные ядра поддерживают широкий спектр числовых форматов, включая FP64, FP32, TF32, BF16, FP16, INT8 и INT4, что позволяет эффективно использовать смешанную точность и оптимизировать соотношение между скоростью и точностью вычислений.

Согласно официальной документации, модификации A100 на 80 ГБ HBM2e обеспечивают прирост пропускной способности памяти до 1,7 раза по сравнению с предыдущими поколениями и предлагают один из самых высоких показателей пропускной способности памяти среди GPU для дата-центров — свыше 2 ТБ/с. Это особенно важно при работе с большими языковыми моделями, системами рекомендаций и сложными моделями компьютерного зрения, где потребуется сквозной доступ к большим объемам данных без узких мест на уровне памяти. Ускоритель интегрируется в инфраструктуру дата-центра как часть платформы NVIDIA для ИИ и HPC и поддерживает современные программные стеки, включая CUDA, библиотеки для глубокого обучения и оптимизированные фреймворки, что делает A100X 80 GB HBM2e универсальной основой для создания масштабируемых кластеров обучения и инференса.

Архитектура и ключевые характеристики

В основе ускорителей семейства NVIDIA A100, включая версии с 80 ГБ HBM2e, лежит архитектура NVIDIA Ampere, разработанная для задач искусственного интеллекта и высокопроизводительных вычислений в дата-центрах. Архитектура использует чип GA100 с тензорными ядрами третьего поколения и большим числом CUDA‑ядер, а также увеличенным объемом кэша L2 (до 40 МБ), что снижает задержки при доступе к данным и повышает общую эффективность вычислений. Поддержка формата TF32 позволяет значительно ускорить обучение нейросетей по сравнению с классическим FP32, сохраняя при этом сравнимый уровень точности, а использование BF16 и FP16 дополнительно повышает производительность при работе с современными моделями глубокого обучения.

Память HBM2e объемом 80 ГБ обеспечивает пропускную способность порядка 1,9–2,0 ТБ/с, что достигается за счет широкого интерфейса памяти и высоких частот работы микросхем HBM2e. По данным спецификаций, память HBM2e в A100 80 GB обеспечивает до 2 ТБ/с пропускной способности, а эффективное использование встроенного кэша и механизмов предварительной выборки позволяет достичь высокой загрузки вычислительных блоков и минимизировать простои из-за ожидания данных. Такой уровень пропускной способности критичен для задач с интенсивным обменом данными, включая распределенное обучение и крупномасштабное моделирование, где GPU постоянно работают с большими массивами параметров и входных данных.

Ускорители A100 80 GB HBM2e поддерживают работу в составе высокоплотных конфигураций с использованием интерконнекта NVIDIA NVLink и, в случае систем HGX A100, NVSwitch, обеспечивающих межGPU‑пропускную способность до сотен ГБ/с. Это позволяет объединять несколько GPU в единую логическую вычислительную фабрику, уменьшая накладные расходы на обмен данными между ускорителями и повышая эффективность при горизонтальном масштабировании приложений. Набор поддерживаемых программных интерфейсов включает CUDA, DirectCompute, OpenCL и OpenACC, а также полный стек библиотек NVIDIA для линейной алгебры, обработки сигналов, машинного обучения и других прикладных областей.

Также реализована поддержка технологии Multi‑Instance GPU (MIG), которая позволяет разделять ресурсы одного физического GPU на несколько независимых экземпляров с выделенной памятью и вычислительными блоками. В документации указано, что один A100 может быть разделен до семи GPU‑экземпляров, каждый из которых видится системе как отдельный логический ускоритель, что повышает утилизацию оборудования и позволяет гибко обслуживать множество разнородных задач в рамках одного узла.

Сценарии применения

Ускоритель NVIDIA A100X 80 GB HBM2e ориентирован на использование в масштабируемых инфраструктурах ИИ, аналитики данных и высокопроизводительных вычислений, где требуется высокая пропускная способность памяти, мощные тензорные ядра и поддержка смешанной точности. Ускоритель применяется как в корпоративных дата-центрах, так и в исследовательских организациях и публичных облаках, обеспечивая базовую платформу для широкого спектра задач — от разработки моделей до их промышленной эксплуатации.

- Идеально подходит для обучения нейросетей (Deep Learning), включая крупные модели компьютерного зрения, обработки естественного языка, рекомендационные и мультимодальные модели, требующие большого объема видеопамяти и высокой пропускной способности HBM2e.

- Оптимален для инференса LLM‑моделей и других больших моделей, обеспечивая низкую задержку обработки запросов, высокую пропускную способность по числу одновременных сессий и поддержку MIG для разделения ресурсов между множеством сервисов.

- Подходит для высокопроизводительных вычислений (HPC), включая численное моделирование, вычислительную гидродинамику, климатическое моделирование, биоинформатику, квантовую химию и другие ресурсоемкие научно‑технические задачи.

- Используется для аналитики больших данных и ускорения систем бизнес‑аналитики, где необходимо быстро выполнять сложные аналитические запросы, применять алгоритмы машинного обучения и обрабатывать большие массивы структурированных и неструктурированных данных.

- Подходит для конвергированных AI‑и HPC‑кластеров, где на одной инфраструктуре одновременно работают обучающие задачи, инференс и численные модели, требующие тесной интеграции и высокой пропускной способности межGPU‑интерконнекта.

Совместимость

Ускорители NVIDIA A100 80 GB HBM2e входят в состав решений, сертифицированных по программе NVIDIA‑Certified Systems, и используются в ряде серверных платформ ведущих производителей, обеспечивающих проверенную совместимость на уровне аппаратуры, прошивок и программного стека. Это позволяет использовать ускоритель в готовых системах и решениях для ИИ и HPC без необходимости самостоятельной глубокой валидации конфигураций.

- Ускоритель протестирован на совместимость с серверными платформами Dell PowerEdge, входящими в состав решений на базе NVIDIA A100, применяемых в системах DGX и в платформах для кластеров AI и HPC.

- Проверена работа с серверами HPE, которые входят в перечень систем, поддерживающих GPU NVIDIA A100 80 GB HBM2e и предлагаются как готовые решения для задач ИИ, аналитики и высокопроизводительных вычислений.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro, в том числе с системами, сертифицированными для работы с NVIDIA A100 и ориентированными на построение плотных GPU‑кластеров для Deep Learning и HPC.

Помимо указанных платформ, поддержка GPU NVIDIA A100 80 GB HBM2e заявлена в составе систем других партнеров, входящих в программу NVIDIA‑Certified Systems, что расширяет выбор готовых конфигураций для развертывания кластеров ИИ и HPC. Наличие таких сертифицированных решений обеспечивает предсказуемые показатели производительности и надежности, а также упрощает обслуживание и обновление инфраструктуры за счет согласованности аппаратных компонентов и программных стэков.

Инфраструктура и управляемость

Ускоритель NVIDIA A100X 80 GB HBM2e интегрируется в экосистему программных решений NVIDIA для дата-центров, включая платформу NVIDIA AI Enterprise, контейнеры с оптимизированными фреймворками и инструменты мониторинга и управления GPU. Использование средств управления, входящих в состав решений NVIDIA для дата-центров, позволяет контролировать загрузку ускорителей, энергопотребление, температуры и другие параметры, а также оптимизировать распределение задач между узлами и кластерами.

Благодаря поддержке технологии Multi‑Instance GPU и возможностям масштабирования с использованием NVLink и NVSwitch, ускорители на базе NVIDIA A100 80 GB HBM2e служат базовым строительным блоком для построения кластеров обучения, инференса, аналитики и HPC в корпоративных, научных и облачных средах. Это позволяет организациям стандартизировать вычислительную платформу, упростить управление ресурсами и обеспечить устойчивый рост производительности по мере расширения нагрузок и числа пользователей.

подбор оборудования

до 90 дней