Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 26.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

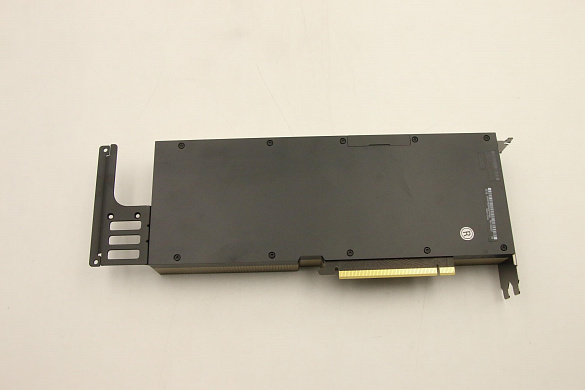

Видеокарта NVIDIA A30 24GB HBM2

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA A30 24GB HBM2

Лицензии

Описание

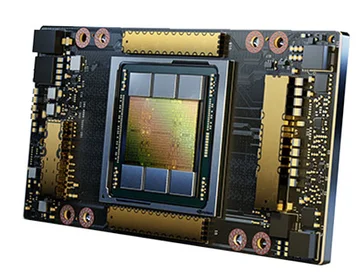

NVIDIA A30 24 GB — это тензорный ускоритель архитектуры NVIDIA Ampere, ориентированный на универсальное ускорение вычислений в корпоративных серверных платформах для задач искусственного интеллекта, инференса и высокопроизводительных вычислений. Ускоритель позиционируется как решение для «mainstream enterprise servers» и обеспечивает баланс между производительностью, энергоэффективностью и возможностью масштабирования в стандартных 2U/4U‑серверах. Карта оснащена 24 ГБ памяти HBM2/HBM2e с пропускной способностью порядка 933 ГБ/с и поддержкой ECC, что позволяет уверенно работать с интенсивными по памяти AI‑ и HPC‑нагрузками. Поддержка форматов TF32 и FP64 Tensor Core делает NVIDIA A30 эффективным как для обучения и инференса нейросетей, так и для классических задач научных вычислений с двойной точностью.

Согласно официальным спецификациям, NVIDIA A30 выполнен в двухслотовом форм‑факторе FHFL (full-height, full-length) с пассивным охлаждением и интерфейсом PCIe Gen4 x16, обеспечивающим до 64 ГБ/с пропускной способности между GPU и хост‑системой. Максимальная тепловая мощность (TDP) составляет 165 Вт, используется один 8‑контактный разъем дополнительного питания, что делает карту совместимой с широким спектром современных серверных платформ. Ускоритель поддерживает Multi‑Instance GPU (MIG), позволяющий делить один физический GPU на несколько независимых логических экземпляров с выделенной памятью (до 4 MIG по 6 ГБ или 2 MIG по 12 ГБ, а также режим одного экземпляра на 24 ГБ). Это расширяет сценарии применения A30 в мультиарендных и консолидированных инфраструктурах, где требуется изоляция и гарантированное качество обслуживания для разных рабочих нагрузок.

Архитектура и ключевые характеристики

В основе NVIDIA A30 лежит графический процессор архитектуры NVIDIA Ampere, использующий тензорные ядра третьего поколения и поддерживающий широкий спектр числовых форматов для задач искусственного интеллекта и высокопроизводительных вычислений. В datasheet указывается, что A30 поддерживает FP64 Tensor Core и TF32 Tensor Core, а также форматы BF16, FP16, INT8 и INT4, что позволяет гибко подбирать компромисс между точностью и производительностью в зависимости от конкретной задачи. Пиковая производительность FP64 Tensor Core оценивается примерно в 10,3 TFLOPS, а TF32 Tensor Core — до 82 TFLOPS (165 TFLOPS со структурированным sparsity).

Подсистема памяти NVIDIA A30 представлена 24 ГБ HBM2/HBM2e с пропускной способностью 933 ГБ/с и поддержкой коррекции ошибок ECC. Такое сочетание объема и пропускной способности памяти позволяет эффективно обрабатывать крупные наборы данных и модели, характерные для задач аналитики, машинного обучения и HPC. Использование высокоскоростной HBM2 в корпусировке CoWoS, отмеченное в спецификациях партнёров, снижает задержки и повышает энергоэффективность относительно решений на базе GDDR‑памяти. Интерфейс PCIe Gen4 x16 обеспечивает высокую пропускную способность подключения к CPU и сетевым адаптерам, а поддержка третьего поколения NVIDIA NVLink (в ряде конфигураций) позволяет объединять несколько A30 в более тесно связанный кластер с межGPU‑пропускной способностью до 200 ГБ/с.

Форм‑фактор NVIDIA A30 — двухслотовая полноразмерная карта FHFL с пассивным охлаждением, рассчитанная на установку в серверные шасси с фронт‑ту‑бэк воздушным потоком. Максимальное энергопотребление 165 Вт и возможность питания от одного 8‑контактного разъема делают карту привлекательной для массовых серверных конфигураций, не требующих радикальной модернизации системы питания. В спецификациях также отмечаются поддержка NEBS Level 3 для соответствующих исполнений, аппаратный root‑of‑trust и безопасная загрузка, что важно для операторских и корпоративных сред с повышенными требованиями к надежности и безопасности.

Ключевой особенностью архитектуры A30 является поддержка технологии Multi‑Instance GPU (MIG): один физический GPU может быть разделен на 4 экземпляра по 6 ГБ или 2 экземпляра по 12 ГБ, либо использоваться как единый ресурс с 24 ГБ памяти. Каждый MIG‑экземпляр получает выделенный набор вычислительных блоков и объём памяти, видимый операционной системе как отдельный GPU, что обеспечивает изоляцию и гарантированное качество обслуживания при совместном использовании ресурсов несколькими рабочими нагрузками. Это делает NVIDIA A30 удобным выбором для консолидированных AI‑кластеров, где сочетаются различные по масштабу и профилю задачи.

Сценарии применения

NVIDIA A30 24 GB позиционируется как универсальный ускоритель для основных корпоративных серверов, предназначенный для широкого спектра задач искусственного интеллекта, высокопроизводительных вычислений и аналитики. Поддержка TF32, FP64 Tensor Core, HBM‑памяти и технологии MIG позволяет использовать карту как в отдельных узлах, так и в составе масштабируемых кластеров с многопользовательской загрузкой.

- Идеально подходит для обучения нейросетей (Deep Learning) в корпоративных и исследовательских средах, где требуются высокое соотношение производительности к стоимости и энергоэффективности, а также поддержка смешанной точности (TF32, BF16, FP16).

- Эффективен для инференса LLM‑моделей и других крупных моделей, обеспечивая высокую пропускную способность по количеству запросов и возможность разделения ресурса GPU между несколькими сервисами с помощью MIG‑экземпляров.

- Подходит для высокопроизводительных вычислений (HPC), включая численное моделирование, вычислительную механику, финансовые расчёты и другие задачи, требующие FP64 Tensor Core и высокой пропускной способности памяти.

- Используется для аналитики больших данных и ускорения систем бизнес‑аналитики, когда необходимо ускорить ETL‑процессы, сложные запросы и применение алгоритмов машинного обучения к крупным наборам данных.

- Рекомендован для конвергированных нагрузок, где на одном серверном кластере одновременно выполняются задачи AI‑обучения, инференса, HPC и аналитики, требующие гибкого распределения ресурсов между несколькими командами и приложениями.

Совместимость

NVIDIA A30 24 GB входит в перечень решений, поддерживаемых программой NVIDIA‑Certified Systems, и используется в составе серверных платформ ведущих производителей, что подтверждено официальной документацией NVIDIA и OEM‑партнёров. Участие в программе NVIDIA‑Certified Systems означает, что конфигурации с A30 проходят тестирование на производительность, управляемость, безопасность и масштабируемость.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge, входящими в программу NVIDIA‑Certified Systems и предлагающими конфигурации с GPU NVIDIA A30 для задач AI, инференса и HPC в корпоративных средах.

- Проверена работа с серверами HPE ProLiant, которые в рамках NVIDIA‑Certified Systems поддерживают установку NVIDIA A30 PCIe Gen4 и используются для развертывания кластеров ИИ и высокопроизводительных вычислений.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro, включая систему Supermicro SYS‑210GP‑DNR и другие модели, где в таблицах совместимости прямо указана поддержка NVIDIA PCIe A30 (до 3 GPU на узел).

Кроме указанных производителей, A30 поддерживается и рядом других партнёров NVIDIA, перечисленных в документации по NVIDIA‑Certified Systems, что позволяет подбирать готовые конфигурации для различных форм‑факторов и уровней плотности. Наличие сертифицированных систем снижает риски при внедрении, упрощает интеграцию в существующую инфраструктуру и гарантирует предсказуемое поведение ускорителя под типичными проверочными нагрузками AI, HPC и аналитики.

Инфраструктура и управляемость

NVIDIA A30 24 GB органично интегрируется в программную экосистему NVIDIA для дата‑центров, включая NVIDIA AI Enterprise, CUDA‑стек, библиотеки для глубокого обучения и аналитики, а также инструменты мониторинга и управления GPU. Поддержка стандартных драйверов для дата‑центров и интеграция с контейнерными стеками (NGC‑контейнеры, Kubernetes‑окружения и др.) позволяют быстро развертывать типовые решения для обучения и инференса на базе A30.

Наличие технологии Multi‑Instance GPU упрощает управление ресурсами: администраторы могут выделять отдельные MIG‑экземпляры под разные сервисы и команды, обеспечивая изоляцию, прогнозируемую производительность и высокую утилизацию GPU. В сочетании с сертифицированными серверными платформами и инструментами NVIDIA для мониторинга, телеметрии и обновления прошивок это делает NVIDIA A30 24 GB удобным строительным блоком для построения масштабируемых AI‑ и HPC‑кластеров в корпоративных, научных и облачных средах.

подбор оборудования

до 90 дней