Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 13.04.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

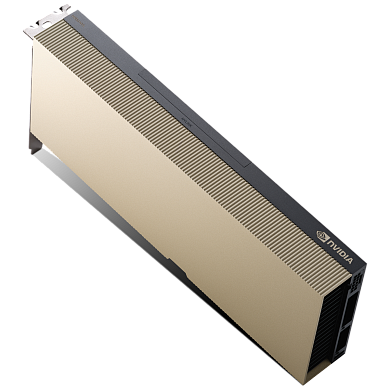

Видеокарта NVIDIA H100 80GB PCIe HBM3

Гарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA H100 80GB PCIe HBM3

Лицензии

Описание

NVIDIA H100 PCIe 80GB — это флагманский графический ускоритель на архитектуре Hopper, ориентированный на обучение и инференс крупных нейросетей, высокопроизводительные вычисления (HPC), работу с LLM-моделями и аналитикой данных в корпоративных дата-центрах. Согласно официальному Product Brief NVIDIA H100 PCIe GPU, плата представляет собой двухслотовый пассивно охлаждаемый ускоритель с интерфейсом PCIe Gen5 x16, оснащённый 80 ГБ высокоскоростной памяти HBM2e и поддержкой четвёртого поколения тензорных ядер NVIDIA с новым форматом FP8. В официальной линейке H100 подчёркивается, что GPU с архитектурой Hopper и Transformer Engine обеспечивает до 4× ускорения обучения по сравнению с предыдущим поколением для моделей масштаба GPT‑3 (175B), а также существенный прирост скорости инференса LLM. Спецификации указывают до 183 TFLOPS FP32, до 67 TFLOPS FP64, до 3 958 TFLOPS FP8/INT8 Tensor Core и пропускную способность памяти порядка 2 ТБ/с для PCIe‑варианта с 80 ГБ HBM2e.

Форм-фактор NVIDIA H100 PCIe 80GB — это двухслотовая плата PCIe с пассивным радиатором (Dual-Slot Passive Fansink), рассчитанная на установку в серверные шасси с продольным воздушным потоком и поддержкой PCIe Gen5. В официальных даташитах указано, что H100 PCIe поддерживает до 7 MIG‑экземпляров по 10 ГБ каждый или до 14 MIG по 12 ГБ в некоторых конфигурациях, что позволяет разделять один ускоритель между несколькими независимыми рабочими нагрузками. Максимальное теплопакет (TDP) для PCIe‑варианта составляет порядка 300–350 Вт (configurable), а пропускная способность межсоединения NVLink достигает 600 ГБ/с, при этом PCIe Gen5 предоставляет до 128 ГБ/с между GPU и хост‑системой. Это делает NVIDIA H100 PCIe 80GB универсальным ускорителем для широкого спектра задач ИИ и HPC в системах с 1–8 GPU.

Архитектура и ключевые характеристики

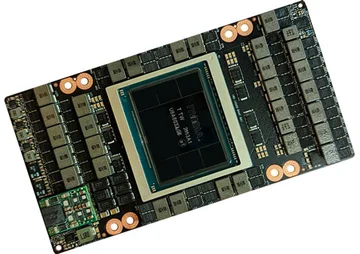

В основе NVIDIA H100 PCIe 80GB лежит архитектура NVIDIA Hopper — специализированная архитектура для ускорения ИИ и HPC‑нагрузок, оснащённая тензорными ядрами четвёртого поколения и Transformer Engine с поддержкой FP8‑точности. По сводным спецификациям, GPU H100 PCIe содержит 14 592 CUDA‑ядра, 456 тензорных ядер и поддерживает широкий набор форматов: FP64, FP32, TF32, FP16, BF16, INT8, INT4 и FP8. Это позволяет эффективно комбинировать точность и производительность под конкретные задачи — от классических численных расчётов до обучения и инференса больших языковых моделей.

Память NVIDIA H100 PCIe 80GB реализована на базе HBM2e объёмом 80 ГБ. В Product Brief и даташитах приводится память типа HBM2e, частота памяти 1 593 MHz и объём 80 GB, а в сводных таблицах — пропускная способность до 2 ТБ/с для PCIe‑варианта. Такая конфигурация памяти обеспечивает высокую пропускную способность и достаточный объём для хранения параметров и активаций крупномасштабных моделей, а также данных для HPC‑нагрузок. В таблицах Cisco и общих даташитах для H100 указывается, что карты с 80 ГБ памяти обеспечивают пропускную способность до 3,35 ТБ/с для SXM‑варианта и около 2 ТБ/с для PCIe‑форм‑фактора.

С точки зрения производительности тензорных ядер, официальные материалы приводят показатели: до 1 979 TFLOPS FP8 Tensor Core и до 3 958 TFLOPS FP8/INT8 Tensor Core (с учётом sparsity) для H100, а также сопоставимые значения для PCIe‑варианта (несколько ниже, чем у SXM, но на том же порядке величины). Для классических форматов указываются до 67 TFLOPS FP64, до 183 TFLOPS FP32 и до 366 TFLOPS TF32 (с тензорными ядрами), что делает H100 PCIe одним из самых производительных ускорителей для HPC и ИИ. Поддержка DPX‑инструкций (Dynamic Programming accelerators) дополнительно ускоряет задачи биоинформатики, маршрутизации и оптимизации.

Форм‑фактор и интерфейсы NVIDIA H100 PCIe 80GB описаны как PCIe Dual-Slot Passive Fansink, NVLink до 600 GB/s и PCIe Gen5 x16 с пропускной способностью 128 GB/s. В даташите Megware указывается, что PCIe‑вариант имеет конфигурируемый TDP 300–350 W и поддерживает до 7 MIG экземпляров по 10 ГБ каждый. NVIDIA позиционирует H100 PCIe как часть NVIDIA‑сертифицированных систем и партнёрских серверов с конфигурациями от 1 до 8 GPU, а также основой для кластеров с использованием NVLink и InfiniBand NDR в составе Magnum IO и сетевой инфраструктуры NVIDIA.

С точки зрения программной экосистемы, H100 PCIe входит в платформу NVIDIA для ИИ и HPC: включает лицензию NVIDIA AI Enterprise (для ряда OEM‑поставок), поддерживает Kubernetes‑ориентированные стеки, библиотеки CUDA, cuDNN, TensorRT, NCCL и полный набор фреймворков глубокого обучения. H100 также поддерживает NVIDIA Confidential Computing — аппаратно реализованные функции доверенных сред выполнения для защиты данных и моделей в процессе вычислений. Всё это делает H100 PCIe 80GB ключевым элементом современной инфраструктуры ИИ и суперкомпьютинга.

Сценарии применения

NVIDIA H100 PCIe 80GB позиционируется как универсальный ускоритель для задач искусственного интеллекта, больших языковых моделей, высокопроизводительных вычислений и аналитики данных в корпоративных и научных центрах. Архитектура Hopper, тензорные ядра четвёртого поколения и 80 ГБ HBM2e обеспечивают высокую эффективность как при обучении, так и при инференсе моделей различных масштабов.

- Идеально подходит для обучения нейросетей (Deep Learning) крупного масштаба, включая генеративные модели, модели компьютерного зрения и рекомендательные системы: Transformer Engine с FP8 позволяет ускорять обучение GPT‑подобных моделей до 4 раз по сравнению с предыдущим поколением, оставаясь при этом в рамках доступной точности.

- Подходит для инференса LLM‑моделей, в том числе чат‑ботов и сервисов генеративного ИИ: поддержка FP8, INT8 и MIG‑разделения позволяет размещать несколько экземпляров моделей, оптимизировать задержку и пропускную способность при обслуживании большого количества одновременных запросов.

- Может использоваться для высокопроизводительных вычислений (HPC): FP64‑производительность до десятков TFLOPS и высокая пропускная способность памяти делают H100 PCIe эффективным для задач моделирования в науке, инженерных расчётов, CFD, финансовых вычислений и симуляций с большими объёмами данных.

- Оптимальна для задач аналитики данных и обработки больших массивов (Big Data и Data Analytics), когда требуются ускоренные библиотеки для обработки, агрегации и машинного обучения, работающие поверх CUDA и NVIDIA AI Enterprise.

- Подходит для построения конвергентных ИИ‑кластеров и гибридных систем, где H100 PCIe сочетается с CPU (включая NVIDIA Grace) и высокоскоростными сетями InfiniBand NDR, обеспечивая масштабирование от одиночного сервера до суперкомпьютерных комплексов.

Совместимость

NVIDIA H100 PCIe 80GB спроектирован для работы в современных серверных платформах с поддержкой PCIe Gen5, достаточной мощностью питания и продуманной системой охлаждения, а также поставляется как часть сертифицированных решений ведущих производителей серверов. Форм‑фактор «PCIe dual-slot passive» подразумевает установку ускорителя в стандартные слоты PCIe x16 с обеспечением продольного воздушного потока через радиатор.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge, включая конфигурации с поддержкой NVIDIA H100 80GB PCIe для задач ИИ, LLM и HPC в линейках Dell PowerEdge XE и R‑серий, указанных в списках NVIDIA‑сертифицированных систем и документации партнёров.

- Проверена работа с серверами и системами HPE: на официальной странице «NVIDIA H100 80GB PCIe Accelerator for HPE» указано, что ускоритель поддерживается в системах HPE ProLiant и HPE Cray для задач генеративного ИИ, компьютерного зрения, LLM, научных расчётов и финансового моделирования.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro и другими NVIDIA‑сертифицированными OEM‑партнёрами: в даташитах и описаниях NVIDIA Certified Systems указываются системы Supermicro с поддержкой 1–8 GPU H100 PCIe, рассчитанные на ИИ, LLM и HPC‑нагрузки.

При интеграции NVIDIA H100 PCIe 80GB необходимо учитывать требования к электропитанию и охлаждению: конфигурируемый TDP 300–350 Вт требует наличия достаточного запаса по мощности блока питания и правильной организации воздушного потока в шасси, особенно при установке нескольких ускорителей в одном сервере. В документации HPE и других OEM‑партнёров подробно описываются поддерживаемые конфигурации (количество GPU, размещение слотов, лимиты мощности), а NVIDIA сертифицирует серверы с 1–8 ускорителями H100 PCIe в составе NVIDIA‑сертифицированных систем.

Инфраструктура и программная поддержка

NVIDIA H100 PCIe 80GB интегрируется в полную программную экосистему NVIDIA для ИИ и HPC: CUDA, cuDNN, TensorRT, NCCL, Magnum IO, а также платформу NVIDIA AI Enterprise, которая поставляется вместе с рядом OEM‑конфигураций H100. Это позволяет строить кластеры для обучения и инференса моделей любого масштаба, от одиночных серверов до распределённых суперкомпьютерных систем, использующих InfiniBand NDR, NVLink и программные стеки NVIDIA.

Поддержка Multi‑Instance GPU (до 7 MIG по 10 ГБ или до 14 MIG по 12 ГБ в зависимости от конфигурации), аппаратного конфиденциального вычисления (NVIDIA Confidential Computing), а также широкого набора форматов вычислений (FP64, FP32, TF32, FP16, BF16, INT8, FP8) делает NVIDIA H100 PCIe 80GB базовым элементом инфраструктуры для генеративного ИИ, LLM, HPC и аналитики данных. В сочетании с серверными платформами Dell, HPE, Supermicro и NVIDIA‑сертифицированными системами ускоритель обеспечивает предсказуемую производительность, масштабируемость и поддержку корпоративного ПО для построения современных ИИ‑решений.

подбор оборудования

до 90 дней