Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 26.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

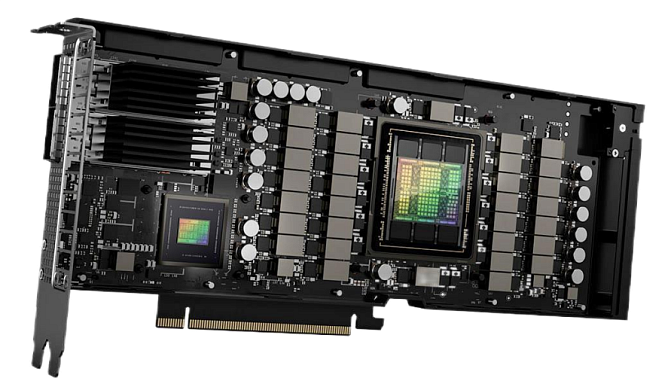

Видеокарта NVIDIA H100 80GB SXM5 HBM3

Графический процессор NVIDIA H100 Tensor Core обеспечивает исключительную производительность, масштабируемость и безопасность для любых рабочих нагрузок. H100 использует революционные инновации, основанные на архитектуре NVIDIA Hopper™, для создания лучшего в отрасли диалогового ИИ, ускоряющего работу больших языковых моделей в 30 раз.

Гарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA H100 80GB SXM5 HBM3

Лицензии

Описание

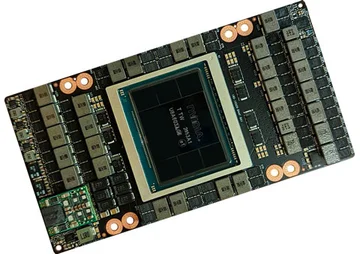

NVIDIA H100 SXM5 80GB — это флагманский ускоритель на архитектуре NVIDIA Hopper, ориентированный на обучение и инференс крупнейших нейросетей, работу с LLM-моделями и высокопроизводительные вычисления (HPC) в составе GPU-серверов нового поколения. В официальных материалах H100 описывается как «масштабный скачок в ускоренных вычислениях», при этом именно модуль SXM5 80GB является максимальной по производительности конфигурацией для плотных GPU-узлов и ИИ-суперкомпьютеров. По данным объединённых даташитов, H100 SXM5 оснащён 80 ГБ памяти HBM3 с пропускной способностью до 3,0–3,35 ТБ/с и тензорными ядрами четвёртого поколения с поддержкой FP8 и Transformer Engine, обеспечивающими до 1 979 TFLOPS FP8 (до 3 958 TFLOPS с учётом sparsity). Ускоритель рассчитан на теплопакет до 700 Вт (configurable TDP), устанавливается в GPU-шасси с разъёмами SXM5 и поддерживает NVLink четвёртого поколения с суммарной полосой до 900 ГБ/с между GPU.

В даташите NVIDIA H100 Tensor Core GPU указывается, что SXM-вариант является основой для масштабируемых узлов на 4–8 GPU с дальнейшим расширением через NVSwitch до десятков тысяч GPU в одном кластере, что критично для задач генеративного ИИ и LLM‑кластеров. H100 SXM5 80GB поддерживает Multi‑Instance GPU (MIG), позволяя делить один физический ускоритель на несколько изолированных GPU-инстансов для разных рабочих нагрузок и арендаторов. В архитектурном описании подчёркивается наличие DPX‑инструкций для ускорения задач динамического программирования, специализированных блоков декодирования (до 7 NVDEC и 7 JPEG‑декодеров) и поддержку аппаратно защищённых вычислений (Confidential Computing). Всё это делает NVIDIA H100 SXM5 80GB ключевым элементом современных серверных платформ для ИИ и HPC.

Архитектура и ключевые характеристики

Архитектура NVIDIA H100 SXM5 80GB основана на NVIDIA Hopper — специализированной архитектуре для задач ИИ и высокопроизводительных вычислений, ориентированной на ускорение трансформерных моделей и смешанной точности вычислений. В объединённых спецификациях для H100 указано, что GPU Hopper содержит тысячи CUDA-ядер и тензорные ядра четвёртого поколения, поддерживающие форматы FP64, FP32, TF32, FP16, BF16, INT8, INT4 и новый формат FP8, реализуемый через Transformer Engine. Transformer Engine автоматически выбирает между FP8 и более высокими форматами для отдельных слоёв модели, что позволяет существенно увеличить скорость обучения и инференса без заметной потери качества.

Память NVIDIA H100 SXM5 80GB представлена 80 ГБ HBM3 с пропускной способностью до 3,0–3,35 ТБ/с, что прямо указано в даташитах NVIDIA и партнёров. В таблицах Megware и других поставщиков приводятся значения: GPU memory 80GB HBM3, bandwidth 3.35TB/s для SXM-варианта и 2TB/s для PCIe-варианта. Такая пропускная способность критична для эффективного обучения и инференса крупных моделей, где необходимо быстро передавать большие объёмы параметров и активаций. Кроме того, H100 поддерживает многократные декодеры NVDEC и JPEG (до 7 каждого типа), что позволяет параллельно обрабатывать видеопотоки и изображения при подготовке данных.

С точки зрения производительности, в даташитах NVIDIA и партнёров для H100 SXM указываются следующие ориентиры: до десятков TFLOPS в FP64, свыше 60 TFLOPS в FP64 Tensor, до сотен TFLOPS в FP32/TF32 и до 1 979 TFLOPS FP8 (3 958 TFLOPS FP8/INT8 с учётом sparsity). GPU.fm для H100 80GB SXM5 приводит ключевые показатели: 80GB HBM3, 3 TB/s bandwidth, NVLink 4.0 c 900 GB/s совокупной двунаправленной пропускной способностью, 1 979 TFLOPS FP8 и TDP 700W. Поддержка DPX-инструкций (Dynamic Programming accelerators) ускоряет задачи биоинформатики (выравнивание последовательностей), маршрутизации и оптимизации, а также ряда алгоритмов динамического программирования в HPC.

Форм-фактор H100 SXM5 80GB — это модуль SXM5, устанавливаемый непосредственно на специальную GPU-плату/модуль сервера, в отличие от форм-фактора PCIe. В документации по сравнению H100 PCIe и H100 SXM на примере Dell PowerEdge R760xa и XE9680 подчёркивается, что SXM‑вариант обеспечивает более высокую пропускную способность NVLink, более низкие задержки и более высокий TDP (до 700 W), что даёт преимущество в длительных ИИ‑нагрузках и многогранных конфигурациях на 8 GPU. SXM5 также упоминается как форма, оптимизированная для прямого жидкостного охлаждения и плотной компоновки GPU в специализированных шасси.

Архитектурно NVIDIA H100 SXM5 80GB интегрируется в полную экосистему NVIDIA для ИИ и HPC: поддерживает CUDA, cuDNN, TensorRT, NCCL, Magnum IO, а также программную платформу NVIDIA AI Enterprise, которая может включаться в состав OEM‑комплектов. Поддержка Multi‑Instance GPU (MIG) позволяет делить один физический GPU на несколько независимых изолированных экземпляров для разных задач или пользователей, обеспечивая лучшее использование ресурса в мультиарендных и облачных средах. Всё это делает архитектуру H100 SXM5 базовой для современных ИИ‑кластеров и суперкомпьютеров.

Сценарии применения

NVIDIA H100 SXM5 80GB разработан как универсальный ускоритель для самых ресурсоёмких задач искусственного интеллекта, обработки естественного языка, генеративных моделей и высокопроизводительных вычислений, где требуются максимальная производительность и масштабируемость. Благодаря архитектуре Hopper, памяти HBM3 и NVLink 4.0, модуль SXM5 нацелен на конфигурации с несколькими GPU в одном узле и масштабирование на уровне стойки и дата-центра.

- Идеально подходит для обучения нейросетей (Deep Learning) самого крупного масштаба, включая генеративные модели (GPT‑подобные LLM, мультимодальные модели, diffusion‑модели): Transformer Engine с FP8 обеспечивает кратный прирост скорости обучения при сохранении качества, а 80 ГБ HBM3 позволяют размещать большие модели и крупные батчи на одном ускорителе.

- Подходит для инференса LLM‑моделей и других сервисов генеративного ИИ: поддержка FP8/INT8, NVLink 4.0 и MIG позволяют обслуживать множество параллельных сессий, снижая задержки и увеличивая пропускную способность инференс‑кластеров для чат‑ботов, ассистентов и рекомендательных систем.

- Может использоваться для высокопроизводительных вычислений (HPC): FP64‑производительность, DPX‑инструкции, высокая пропускная способность памяти и NVLink делают H100 SXM5 эффективным для задач моделирования в физике, химии, биоинформатике, климатическом моделировании и финансовых расчётах.

- Оптимален для задач аналитики данных и конвергентных ИИ+HPC‑нагрузок, где на одной платформе выполняются ETL, аналитика, обучение и инференс, используя библиотеки из состава CUDA‑экосистемы и NVIDIA AI Enterprise.

- Подходит для построения масштабируемых ИИ‑кластеров и суперкомпьютеров, где десятки и сотни узлов с H100 SXM5 объединяются через NVLink и высокоскоростные сети (например, InfiniBand NDR) в единую систему для задач мирового уровня.

Совместимость

NVIDIA H100 SXM5 80GB предназначен для работы в специализированных серверных платформах с поддержкой модулей SXM5, высоких уровней энергопотребления (до 700 Вт на GPU) и развитых систем воздушного или жидкостного охлаждения. Ускоритель входит в состав NVIDIA‑сертифицированных систем и OEM‑решений ведущих производителей серверов, в том числе Dell, HPE и Supermicro.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge XE9680 и другими системами Dell, где H100 SXM используется в конфигурациях с 8 GPU на узел для задач генеративного ИИ, LLM и HPC; сравнение H100 PCIe в R760xa и H100 SXM в XE9680 показывает преимущества SXM‑варианта по пропускной способности и задержкам.

- Проверена работа с серверами и системами HPE, включая HPE Cray и высокоплотные GPU‑узлы, в которых H100 80GB SXM применяется для задач генеративного ИИ, компьютерного зрения и научных расчётов; соответствующие опции указаны в спецификациях NVIDIA H100 Accelerator for HPE.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro, что подтверждается предложениями GPU‑серверов Supermicro H100 Nvidia с поддержкой модулей SXM5 и конфигурациями на 4–8 GPU для ИИ и HPC‑нагрузок.

При проектировании систем на базе H100 SXM5 80GB необходимо учитывать требования к электропитанию и охлаждению: TDP до 700 W на модуль требует мощных блоков питания, соответствующих VRM на платах GPU‑узлов и эффективного воздушного или жидкостного охлаждения, особенно в конфигурациях на 8 GPU на сервер. NVIDIA и OEM‑партнёры предоставляют подробные руководства по конфигурации (размещение модулей SXM5, лимиты мощности, требования к стойкам и системам охлаждения), а также перечни сертифицированных систем, в которых H100 SXM5 протестирован и поддерживается официально.

Инфраструктура и программная поддержка

NVIDIA H100 SXM5 80GB интегрируется в полную программную экосистему NVIDIA для ИИ и HPC: CUDA, cuDNN, TensorRT, NCCL, Magnum IO, а также платформу NVIDIA AI Enterprise, предназначенную для развертывания и управления ИИ‑нагрузками в корпоративных средах. Поддержка Multi‑Instance GPU (MIG) позволяет делить один GPU на несколько логических ускорителей с гарантированной изоляцией и QoS, что важно для мультиарендных и облачных платформ.

Аппаратная поддержка конфиденциальных вычислений (NVIDIA Confidential Computing), расширенный набор форматов (FP64, FP32, TF32, FP16, BF16, INT8, FP8), DPX‑инструкции и развитая сеть партнёрских решений делают NVIDIA H100 SXM5 80GB базовым строительным блоком инфраструктуры для генеративного ИИ, LLM, HPC и аналитики данных. В сочетании с серверными платформами Dell, HPE, Supermicro и NVIDIA‑сертифицированными системами ускоритель обеспечивает предсказуемую производительность, масштабируемость и готовность к промышленной эксплуатации ИИ‑нагрузок в дата‑центрах по всему миру.

подбор оборудования

до 90 дней