Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 05.04.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

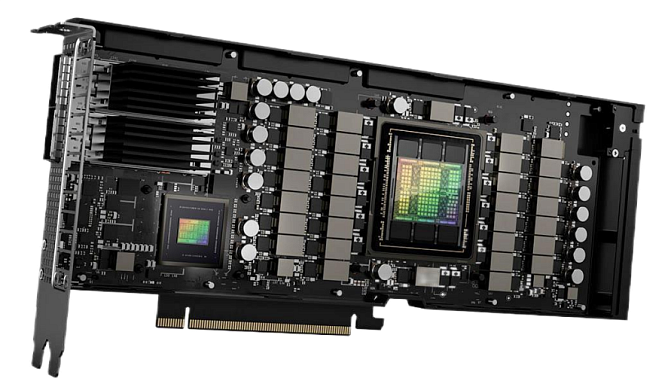

Видеокарта NVIDIA H100 94GB SXM5

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Лицензии

Описание

NVIDIA H100 SXM5 94GB — это высокопроизводительный графический ускоритель на архитектуре NVIDIA Hopper, оснащённый 94 ГБ памяти HBM3 и ориентированный на обучение и инференс крупнейших нейросетей, а также на задачи высокопроизводительных вычислений (HPC) и научного моделирования. По данным технических сводок, H100 SXM5 94GB использует 5‑нм техпроцесс TSMC, содержит около 80 миллиардов транзисторов, 16 896 CUDA‑ядер и 50 МБ кэша L2, обеспечивая теоретическую производительность на уровне примерно 66,9 TFLOPS в FP32 при теплопакете до 700 Вт. Такой набор характеристик делает этот ускоритель одной из наиболее мощных конфигураций в семействе H100, предназначенной для использования в составе GPU‑узлов, серверов и суперкомпьютеров, где критичны плотность вычислительных ресурсов и масштабируемость.

Согласно Technical City и TopCPU, NVIDIA H100 SXM5 94GB относится к модульному форм‑фактору SXM и функционирует в составе серверных платформ с интерфейсом PCIe 5.0 x16 и шиной NVLink, обеспечивающей межсоединение GPU с очень высокой пропускной способностью. Память HBM3 объёмом 94 GB работает на частоте около 1 313 MHz, подключена по 5 120‑битной шине и обеспечивает пропускную способность до 3,36 TB/s, что подтверждается в спецификациях Technical City и TopCPU. Эти показатели существенно превосходят классы предшествующих поколений и даже 80‑гигабайтных вариантов H100, что особенно важно для работы с крупными LLM‑моделями и данными. В списках суперкомпьютеров и энергоэффективных систем (TOP500/Green500) серверные платформы с NVIDIA H100 94GB SXM5 отмечаются как основа для современных вычислительных кластеров с производительностью десятки петафлопс.

Архитектура и ключевые характеристики

Архитектура NVIDIA H100 SXM5 94GB основана на NVIDIA Hopper — специализированной архитектуре для задач ИИ и HPC, оптимизированной под трансформерные модели, смешанную точность и тензорные вычисления. В даташите NVIDIA H100 Tensor Core GPU указано, что H100 SXM‑семейство использует тензорные ядра четвёртого поколения, поддерживающие форматы FP64, FP32, TF32, FP16, BF16, INT8, FP8, а также DPX‑инструкции для ускорения задач динамического программирования. В сводке TopCPU для H100 SXM5 94GB приведены параметры: 16 896 CUDA‑ядер, 132 SM‑блока, 528 TMU, 24 ROP и 50 MB L2‑кэша, что обеспечивает высокую степень параллелизма и эффективную работу сложных нейросетевых и численных алгоритмов.

Память HBM3 объёмом 94 GB является ключевой особенностью данной модификации. Technical City для H100 SXM5 94 GB указывает: 94 GB HBM3, тактовая частота памяти 1 313 MHz, шина памяти 5 120 Bit и пропускная способность 3,36 TB/s. TopCPU подтверждает те же параметры: Memory Size 94GB, Memory Type HBM3, Memory Bus 5120bit, Bandwidth 3.36TB/s. В сравнительных таблицах, посвящённых H100 и A100, отмечается, что H100 (94GB SXM5) имеет память 94 GB и пропускную способность 3,35 TB/s, что выше, чем у H100 80GB и A100 80GB. Такая комбинация объёма и пропускной способности памяти позволяет эффективно работать с очень крупными моделями и длинными контекстами, минимизируя узкие места по доступу к данным.

С точки зрения вычислительной мощности, H100 SXM‑семейство в официальном даташите описывается значениями: FP64 — 34 TFLOPS, FP64 Tensor Core — 67 TFLOPS, FP32 — до десятков TFLOPS, TF32, FP16 и FP8 — до сотен и тысяч TFLOPS за счёт тензорных ядер. TopCPU оценивает теоретическую производительность H100 SXM5 94GB примерно в 66,91 TFLOPS FP32 при TDP 700W. Technical City также подчёркивает, что H100 SXM5 94GB ориентирован на максимальную производительность, а не на энергосбережение, с типичным потреблением на уровне 700 Watt. Для межсоединения GPU используется NVLink (в составе HGX‑платформ), что позволяет объединять несколько модулей H100 SXM5 в единый высокоскоростной узел.

Форм‑фактор H100 SXM5 94GB — модуль SXM5, устанавливаемый на специализированные GPU‑платы HGX, а не классическая плата PCIe. Technical City отмечает, что H100 SXM5 94 GB — «sxm module graphics card attached via PCIe 5.0 x16 interface», при этом модуль потребляет до 700W и требует 8‑pin EPS‑питания, что отражает требования к серверным платформам по части питания и охлаждения. В документах SIE и примерах конфигураций HGX‑кластеров указывается использование 4‑Way HGX с H100 94GB SXM5 в связке с PCIe Gen5, NVLink и InfiniBand NDR, что демонстрирует роль этих модулей в современных ИИ‑суперкомпьютерах.

С точки зрения программной экосистемы H100 SXM5 94GB полностью совместим с программным стеком NVIDIA для ИИ и HPC: CUDA, cuDNN, TensorRT, NCCL, Magnum IO и NVIDIA AI Enterprise. Поддержка Multi‑Instance GPU (MIG) для H100 SXM позволяет делить один физический GPU на несколько изолированных логических экземпляров по 10 GB каждый, что позволяет гибко распределять ресурсы между задачами и арендаторами. В совокупности архитектурные и аппаратные характеристики делают H100 SXM5 94GB одним из наиболее мощных GPU для ИИ и HPC на текущий момент.

Сценарии применения

NVIDIA H100 SXM5 94GB ориентирован на выполнение самых ресурсоёмких задач в области искусственного интеллекта, машинного обучения и высокопроизводительных вычислений, где требуются максимальная производительность, объём памяти и масштабируемость. Увеличенный объём HBM3 и расширенная конфигурация ядер делают этот ускоритель особенно привлекательным для задач генеративного ИИ и работы с LLM‑моделями большого масштаба.

- Идеально подходит для обучения нейросетей (Deep Learning) крупного и сверхкрупного масштаба: 94 GB HBM3, пропускная способность до 3,36 TB/s и 16 896 CUDA‑ядер позволяют обучать большие трансформерные, мультимодальные и diffusion‑модели с крупными батчами и длинным контекстом, используя преимущества Transformer Engine и тензорных ядер четвёртого поколения.

- Подходит для инференса LLM‑моделей (GPT‑класса и выше) и других генеративных AI‑сервисов: увеличенный объём памяти облегчает размещение моделей с большим числом параметров и контекстом, а высокая пропускная способность и специализированные тензорные ядра позволяют достигать низких задержек и высокой пропускной способности при обслуживании большого количества запросов.

- Может использоваться для высокопроизводительных вычислений (HPC): FP32/FP64‑производительность, DPX‑инструкции, HBM3‑память и поддержка CUDA/OpenACC делают H100 SXM5 94GB эффективным ускорителем для задач численного моделирования, биоинформатики, климатического моделирования, инженерных симуляций и финансовых расчётов.

- Оптимален для аналитики больших данных и конвергентных нагрузок ИИ+HPC, где в едином кластере выполняются предобработка данных, классический ML, глубокое обучение и инференс, используя библиотеки из CUDA‑экосистемы и решения уровня NVIDIA AI Enterprise.

- Подходит для построения ИИ‑кластеров и суперкомпьютеров, где десятки и сотни узлов с H100 94GB SXM5 объединяются через NVLink и высокоскоростные сети (например, NDR200 InfiniBand) в единую систему для задач мирового уровня, как это показано в записях TOP500/Green500.

Совместимость

NVIDIA H100 SXM5 94GB предназначен для работы в специализированных серверных платформах и узлах HGX, поддерживающих модули SXM5, высокое энергопотребление (до 700 Вт на модуль) и развитые системы воздушного или жидкостного охлаждения. В списках TOP500 и Green500 указываются реальные системы на базе H100 94GB SXM5, что подтверждает широкое использование этого ускорителя в современных высокопроизводительных кластерах.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge XE9640 и другими системами Dell, где H100 94GB SXM5 используется в конфигурациях с четырьмя GPU в узле в связке с Intel Xeon и InfiniBand NDR200 для задач HPC и ИИ, о чём свидетельствует запись о системе PowerEdge XE9640 в базе TOP500.

- Проверена работа с серверами и системами HPE/Lenovo, применяемыми в Green500‑системах: в списке Green500 упоминаются кластеры на основе ThinkSystem SD665‑N V3 с AMD EPYC и NVIDIA H100 94GB SXM5, что указывает на поддержку этого ускорителя в платформах Lenovo и родственных архитектурно решениях HPE‑класса.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro и другими OEM‑производителями, предлагающими GPU‑серверы с поддержкой HGX H100 и модулей SXM5; такие системы позиционируются как основа для AI‑кластеров, где используются модули H100 80GB и 94GB, с учётом одинаковых требований к SXM5‑интерфейсу, TDP и NVLink‑межсоединению.

При проектировании систем на базе H100 SXM5 94GB необходимо учитывать требования к электропитанию и охлаждению: теплопакет до 700 W на модуль требует мощных блоков питания, соответствующих VRM на платах HGX и эффективного воздушного или жидкостного охлаждения, особенно в конфигурациях с четырьмя или восемью GPU на сервер. Производители серверов и интеграторы (Dell, Lenovo, Supermicro и др.) предоставляют детальные рекомендации по размещению модулей SXM5, количеству ускорителей на узел, профилям мощности и требованиям к стойкам и системам охлаждения в рамках программ NVIDIA‑сертифицированных систем.

Инфраструктура и программная поддержка

NVIDIA H100 SXM5 94GB интегрируется в полную программную экосистему NVIDIA для ИИ и HPC: CUDA, cuDNN, TensorRT, NCCL, Magnum IO и NVIDIA AI Enterprise, что позволяет эффективно использовать его в кластерах для обучения и инференса моделей любого масштаба. Поддержка Multi‑Instance GPU (MIG) даёт возможность делить один физический модуль на несколько изолированных логических GPU, что важно для мультиарендных и облачных платформ.

В сочетании с 16 896 CUDA‑ядрами, 94 GB HBM3 с пропускной способностью 3,36 TB/s, модульным форм‑фактором SXM5, TDP 700W и поддержкой NVLink NVIDIA H100 SXM5 94GB выступает базовым строительным блоком для современных ИИ‑кластеров, LLM‑платформ и HPC‑комплексов. Использование этого ускорителя в системах Dell PowerEdge XE9640, ThinkSystem SD665‑N V3 и GPU‑серверов Supermicro подтверждает его пригодность для реальных задач генеративного ИИ, научных расчётов и аналитики данных в дата‑центрах по всему миру.

подбор оборудования

до 90 дней