Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 26.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

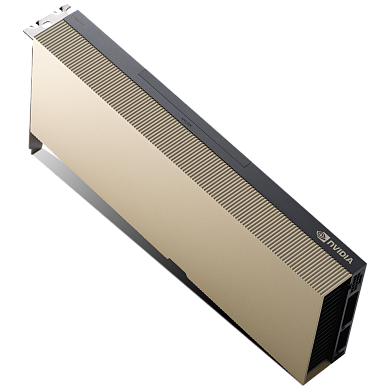

Видеокарта NVIDIA H100 96GB PCIe HBM3

Гарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA H100 96GB PCIe HBM3

Лицензии

Описание

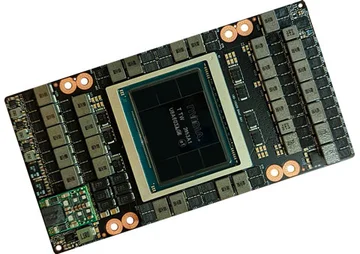

NVIDIA H100 96GB — это профессиональный графический ускоритель на архитектуре NVIDIA Hopper, ориентированный на задачи искусственного интеллекта, обучения и инференса нейросетей, работы с LLM-моделями, а также высокопроизводительных вычислений (HPC) и сложной аналитики данных. В ряде OEM‑поставок и описаний он фигурирует как модификация H100 с увеличенным объёмом памяти до 96 ГБ HBM3, предназначенная для использования в серверных платформах и дата-центрах, где критичны ёмкость и пропускная способность памяти для работы с крупными моделями и массивами данных. По данным технических сводок, такие ускорители предоставляют 96 GB HBM3, до 16 896 шейдерных (CUDA) блоков и теоретическую производительность свыше 60 TFLOPS в FP32 при TDP до 700 W — это сопоставимо с показателями H100 SXM‑уровня и ориентировано на самые тяжёлые ИИ‑нагрузки.

В российском описании OEM‑версии NVIDIA H100 96GB HBM3 указывается, что данный ускоритель относится к корпоративному классу и поставляется под заказ для интеграции в серверы и GPU‑шасси, без ориентации на настольное применение. В видеообзоре и описании ServerFlow подчёркивается, что H100 96GB представляет собой «переосмысление» стандартной версии H100 80GB с увеличенным числом ядер (до 16 896, на ~15% больше, чем у 80GB‑версии) и использованием памяти HBM3 вместо HBM2e, что улучшает пропускную способность и задержки. Отмечается также, что такие OEM‑ускорители официально поддерживаются только под Linux (Ubuntu/Debian/Red Hat и др.), а драйверы для Windows не распознают это устройство из‑за отличающегося ID чипа. Совокупность этих характеристик делает NVIDIA H100 96GB привлекательным выбором для дата‑центров, строящих фабрики ИИ и кластеры для генеративных моделей.

Архитектура и ключевые характеристики

Архитектурно NVIDIA H100 96GB базируется на архитектуре Hopper, то есть наследует все ключевые особенности семейства H100: тензорные ядра четвёртого поколения, поддержку Transformer Engine и аппаратную оптимизацию под трансформерные модели. В сводке CpuTronic для NVIDIA H100 96GB указывается, что ускоритель оснащён 16 896 shading units (CUDA‑ядер) и 50 MB L2‑кэша, а теоретическая производительность в FP32 достигает порядка 62–63 TFLOPS при базовой частоте около 1 665 MHz и boost‑частоте до 1 837 MHz. Это ставит данную конфигурацию в один ряд с самыми производительными реализациями H100, предназначенными для тяжёлых ИИ‑нагрузок и HPC.

Ключевая особенность модификации H100 96GB — увеличенный объём памяти HBM3. В описаниях CpuTronic и Hardware Galaxy подчёркивается, что ускоритель оснащён 96 GB HBM3 памяти, что даёт ему преимущество по ёмкости по сравнению с широко распространёнными 80‑гигабайтными версиями H100. HBM3 обеспечивает ещё более высокую пропускную способность и оптимизированные задержки по сравнению с HBM2e, что критично для задач, где нужно быстро обрабатывать большие модели и датасеты. Увеличение объёма памяти на 16 ГБ относительно 80‑гигабайтной версии улучшает позиционирование ускорителя для работы с растущими по размеру моделями и контекстами LLM.

По данным CpuTronic, для NVIDIA H100 PCIe 96 GB указываются: 96 GB HBM3, частота памяти 1 313 MHz, 16 896 шейдерных блоков, 50 MB L2‑кэша и TDP до 700 W. Теоретическая производительность оценивается порядка 62,08–63,322 TFLOPS FP32, что согласуется с увеличенным количеством ядер и высокими частотами. В обзоре ServerFlow дополнительно отмечается, что H100 96GB изготавливается по обновлённому 4‑нанометровому техпроцессу, что позволило увеличить число ядер до 16 896 и перейти к HBM3‑памяти. В сумме это даёт более высокий уровень производительности и энергоэффективности по сравнению с классической H100 80GB.

С точки зрения программной совместимости H100 96GB полностью относится к семейству H100: поддерживает CUDA, cuDNN, TensorRT, NCCL и весь стек ИИ‑библиотек NVIDIA, используемых в задачах глубокого обучения, инференса, обработки данных и HPC. Однако OEM‑реализация, описанная ServerFlow, официально поддерживает только Linux‑окружения: в видео указывается, что драйверы NVIDIA для Windows не находят совместимое устройство из‑за другого ID чипа, и для работы требуется развёртывание Linux‑дистрибутивов семейства Ubuntu/Debian/Red Hat. Это подчёркивает ориентацию H100 96GB на серверные среды, где Linux является стандартом де‑факто.

В совокупности архитектура Hopper, 16 896 CUDA‑ядер, 96 GB HBM3, высокий TDP и соответствующая производительность делают NVIDIA H100 96GB одним из наиболее мощных ускорителей для ИИ и HPC среди OEM‑конфигураций на базе H100. Такой GPU предназначен для установки в серверные платформы с поддержкой PCIe Gen5 или модулей SXM‑уровня (в зависимости от конкретной реализации OEM) и работы в составе GPU‑кластеров.

Сценарии применения

NVIDIA H100 96GB ориентирован на самые требовательные сценарии в области искусственного интеллекта, машинного обучения и научных вычислений, где нужны максимальные производительность, объём памяти и пропускная способность. Увеличенный объём HBM3 и расширенная конфигурация ядер позволяют использовать данный ускоритель там, где стандартных 80 ГБ уже недостаточно для комфортной работы.

- Идеально подходит для обучения нейросетей (Deep Learning) крупного и сверхкрупного масштаба: 96 GB HBM3 и 16 896 CUDA‑ядер позволяют обучать большие трансформерные и мультимодальные модели, использовать крупные батчи и длинные контексты, а также уменьшать необходимость агрессивного распределения модели по нескольким GPU.

- Подходит для инференса LLM‑моделей, включая генеративные чат‑боты и системы обработки естественного языка: дополнительная память упрощает размещение моделей с большим числом параметров и длинным контекстом, а высокая производительность и поддержка оптимизированных форматов (через Hopper‑архитектуру и софт‑стек H100) обеспечивают низкую задержку и высокую пропускную способность.

- Может использоваться для высокопроизводительных вычислений (HPC): FP32/FP64‑производительность, высокий TDP и HBM3‑память позволяют эффективно решать задачи численного моделирования, сложных симуляций, финансовой математики и научных расчётов, где важны и вычислительная мощность, и быстрый доступ к данным.

- Оптимален для аналитики больших данных и конвергентных нагрузок ИИ+HPC, где на одной платформе выполняются предобработка данных, классический ML, глубокое обучение и инференс с использованием библиотек CUDA‑экосистемы.

- Подходит для построения ИИ‑кластеров и фабрик данных, где OEM‑варианты H100 96GB интегрируются в стойки с несколькими GPU и высокоскоростными сетями, обеспечивая масштабирование ресурсов для команд разработки, исследований и промышленных ИИ‑сервисов.

Совместимость

NVIDIA H100 96GB предназначен исключительно для серверных платформ и OEM‑решений, поддерживающих соответствующий форм‑фактор (PCIe или SXM‑уровень, в зависимости от конкретной модификации), высокую мощность питания и развитую систему охлаждения. В описаниях поставщиков указывается, что такие ускорители поставляются как часть серверных конфигураций или по отдельному заказу под интеграцию в существующие GPU‑узлы.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge — в том числе с конфигурациями, где H100‑серия (включая OEM‑варианты с увеличенной памятью) используется в системах для ИИ и HPC; об этом свидетельствуют материалы по сравнительному анализу H100 PCIe и SXM в серверах Dell R760xa и XE9680, а также упоминания H100‑семейства в списках NVIDIA‑сертифицированных систем Dell.

- Проверена работа с серверами и системами HPE: официальные страницы «NVIDIA H100 80GB PCIe Accelerator for HPE» и другие материалы по H100‑ускорителям для HPE ProLiant и HPE Cray подтверждают поддержку семейства H100, а OEM‑модификации на 96 GB интегрируются по тем же интерфейсам и требованиям к питанию/охлаждению.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro: в предложениях Supermicro GPU‑серверов H100 Nvidia и партнёрских конфигураций для ИИ‑кластеров указываются системы с поддержкой H100‑серии; OEM‑варианты 96 GB HBM3 учитывают те же требования по PCIe/NVLink, TDP и форм‑фактору, что зафиксировано в спецификациях H100‑генерации.

Важно учитывать, что OEM‑версия H100 96GB, описанная ServerFlow, ориентирована исключительно на Linux‑окружения: поддерживаются дистрибутивы Ubuntu, Debian, Red Hat и им подобные, а драйверы NVIDIA для Windows не распознают устройство из‑за нестандартного ID чипа. При проектировании систем с такими ускорителями необходимо закладывать соответствующие требования к мощности (TDP до 700 W на GPU), к блокам питания и охлаждению, особенно в многокарточных конфигурациях, характерных для ИИ‑кластеров и фабрик данных.

Инфраструктура и программная поддержка

NVIDIA H100 96GB интегрируется в программную экосистему NVIDIA, общую для семейства H100: CUDA, cuDNN, TensorRT, NCCL, Magnum IO, а также платформы уровня NVIDIA AI Enterprise для управления и оркестрации ИИ‑нагрузок. Это позволяет использовать стандартные фреймворки (PyTorch, TensorFlow и др.) и библиотеки для обучения и инференса, рассчитанные на архитектуру Hopper и оптимизированные под тензорные ядра и новые форматы чисел.

OEM‑позиционирование H100 96GB (включая поставки через специализированных интеграторов и серверных реселлеров) ориентировано на крупные дата‑центры и корпоративные площадки, где уже развёрнута Linux‑инфраструктура и используются серверные платформы Dell, HPE, Supermicro и других OEM‑партнёров. В таком окружении NVIDIA H100 96GB выступает высокоёмким и высокопроизводительным строительным блоком для ИИ‑кластеров, фабрик данных, LLM‑платформ и HPC‑комплексов, обеспечивая значительный запас по памяти и производительности по сравнению с базовыми 80‑гигабайтными конфигурациями H100.

подбор оборудования

до 90 дней