Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 26.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

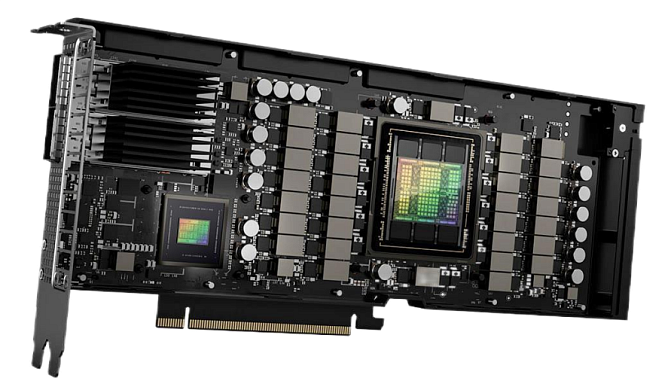

Видеокарта NVIDIA H100 NVL 94GB PCIe HBM3

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA H100 NVL 94GB PCIe HBM3

Лицензии

Описание

NVIDIA H100 NVL 94GB — это специализированный графический ускоритель на архитектуре NVIDIA Hopper, ориентированный на инференс больших языковых моделей (LLM), обучение нейросетей, высокопроизводительные вычисления (HPC) и крупномасштабные AI‑сервисы в дата-центрах. В официальном Product Brief NVIDIA H100 NVL GPU указывается, что карта представляет собой двухслотовый ускоритель формата PCI Express Gen5 с пассивным охлаждением, использующий 94 ГБ памяти HBM3 и обеспечивающий пиковую пропускную способность памяти порядка 3,94 ТБ/с. Решение H100 NVL специально позиционируется как GPU для масштабных задач генеративного ИИ и LLM‑инференса, предлагая по сравнению с предыдущим поколением (A100) до ~12‑кратного ускорения инференса GPT‑3‑класса на уровне дата‑центра благодаря архитектуре Hopper и Transformer Engine. В спецификациях партнёров указывается, что H100 NVL реализован в виде PCIe dual‑slot карты с пассивным радиатором, требующей сквозного воздушного потока и обеспечивающей TDP до 400 Вт на ускоритель.

Особенность NVIDIA H100 NVL 94GB — акцент на сценариях инференса и масштабируемости: в официальных материалах и описаниях партнёров подчёркивается поддержка до 7 мультиэкземпляров GPU (MIG) по 12 ГБ каждый на один ускоритель, а также возможность построения систем с 1–8 H100 NVL на узел в рамках NVIDIA‑сертифицированных систем. Карта использует память HBM3 c интерфейсом до 6 016 бит и тактовой частотой 2 619 MHz, что даёт пиковую пропускную способность 3,938–3,98 ТБ/с для одного GPU. В международных спецификациях указывается, что H100 NVL имеет 14 592 CUDA‑ядра, 456 тензорных ядер четвёртого поколения и достигает до 3 958 TFLOPS FP8 Tensor Core и 3 958 TOPS INT8 Tensor Core (или до 7 916 TFLOPS/ТОPS в двухкарточной паре в NVL‑конфигурации). Это делает H100 NVL 94GB одним из наиболее мощных решений для задач инференса LLM и высокоплотных AI‑нагрузок в PCIe‑форм‑факторе.

Архитектура и ключевые характеристики

Архитектура NVIDIA H100 NVL 94GB основана на архитектуре NVIDIA Hopper, ориентированной на ускорение трансформерных моделей и задач глубокого обучения с использованием тензорных ядер четвёртого поколения и Transformer Engine. В японском даташите NVIDIA H100 NVL 94GB прямо указано: память HBM3 объёмом 94 GB, пропускная способность 3,98 TB/s, ширина шины 5 120 bit (в варианте данной OEM‑платы), интерфейс PCI Express 5.0 x16, 14 592 CUDA‑ядра и 456 тензорных ядер четвёртого поколения. Эти тензорные ядра поддерживают форматы FP64, FP32, TF32, FP16, BF16, INT8, INT4 и FP8, что даёт возможность гибко балансировать между точностью и производительностью в зависимости от задачи.

Память NVIDIA H100 NVL 94GB реализована на базе HBM3. В NVIDIA H100 NVL GPU Product Brief приводятся параметры: memory clock 2 619 MHz, memory type HBM3, memory size 94 GB, memory bus width 6 016 bits и peak memory bandwidth 3 938 GB/s. В японском даташите дополнительно указан параметр «メモリ帯域幅 3.98 TB/s, メモリI/F 5120 bit», что означает пропускную способность 3,98 ТБ/с и интерфейс памяти 5 120 bit для конкретной платной реализации. Различия в числовых значениях отражают разные варианты NVL‑конфигураций, но все они используют HBM3 с пропускной способностью порядка 3,9–4,0 ТБ/с. Такая подсистема памяти позволяет эффективно обрабатывать большие LLM‑модели и массивы данных без «бутылочного горлышка» по памяти.

С точки зрения вычислительной производительности, объединённые спецификации партнёров для H100 NVL приводят следующие показатели: FP64 Tensor Core — 67 TFLOPS, TF32 Tensor Core — 989 TFLOPS, FP16 Tensor Core — 1 979 TFLOPS, FP8 Tensor Core — 3 958 TFLOPS и INT8 Tensor Core — 3 958 TOPS на один ускоритель. В ряде материалов (например, PrimeLine и Tixonic) также указывается конфигурация с «FP8 Tensor Core 7 916 teraFLOPS, INT8 Tensor Core 7 916 TOPS, GPU memory 188 GB HBM3, GPU memory bandwidth 7,8 TB/s» для пары H100 NVL на одной плате или в NVL‑связке 2× GPU. Таким образом, один H100 NVL 94GB обеспечивает до 3 958 TFLOPS FP8 и 3 958 TOPS INT8, а пара, объединённая NVLink, — удвоенные значения.

Форм‑фактор NVIDIA H100 NVL 94GB описан как PCIe dual‑slot air‑cooled. В даташите Exalit отмечается: «dual-slot 10.5 inch PCI Express Gen5 card based on NVIDIA Hopper, passive heatsink, operates up to 400 W TDP». В Tixonic для варианта «NVIDIA H100 GPU HBM3 PCI-E 94GB 350W» указано, что H100 NVL GPU имеет память 94GB HBM3, пропускную способность 7,8TB/s (для двухчиповой конфигурации NVL), FP64 до 68 TFLOPS, FP8 Tensor Core до 7 916 teraFLOPS (в NVL‑связке), 14 NVDEC и 14 JPEG декодеров, TDP 350–400W (конфигурируемый) и до 14 MIG по 12 GB каждый. Exalit подтверждает: TDP 400W, до 7 MIG @ 12GB на один GPU, NVLink межу парами H100 NVL и форм‑фактор PCIe dual‑slot с пассивным охлаждением. Это подчёркивает ориентацию на серверные шасси с мощной системой вентиляции.

С программной точки зрения H100 NVL 94GB поддерживает стандартный набор API и технологий NVIDIA для дата‑центров: CUDA, DirectCompute, OpenCL, OpenACC (в японском даташите перечислены «対応Compute API: CUDA / DirectCompute / OpenCL / OpenACC»), а также проходит сертификации WHQL, RoHS, REACH, CE, FCC и другие, что отражено в списке стандартов «認証規格». Это обеспечивает совместимость ускорителя с основными программными стеками для ИИ и HPC, а также интеграцию в корпоративные среды с жёсткими требованиями к сертификации.

Сценарии применения

NVIDIA H100 NVL 94GB спроектирован для задач, где требуются максимальная производительность на инференсе, большой объём видеопамяти и высокая пропускная способность памяти — прежде всего для генеративного ИИ и больших языковых моделей, но также и для обучения и классических HPC‑нагрузок. Архитектура Hopper, тензорные ядра четвёртого поколения, FP8 и HBM3 делают эту карту центральным элементом инфраструктуры LLM‑и AI‑кластеров.

- Идеально подходит для обучения нейросетей (Deep Learning), включая крупные трансформерные и мультимодальные модели: 94 GB HBM3, пропускная способность до ~3,9–4,0 TB/s и до 3 958 TFLOPS FP8 на GPU позволяют обучать модели большого масштаба с крупными батчами и длинным контекстом, используя преимущества Transformer Engine и тензорных ядер четвёртого поколения.

- Подходит для инференса LLM‑моделей (GPT‑3‑класса и выше) и других генеративных AI‑сервисов: официальные материалы отмечают до 12× ускорение инференса GPT‑3 по сравнению с A100 на уровне дата‑центра, а поддержка FP8/INT8 и MIG позволяет масштабировать количество одновременных сессий при низких задержках и высокой пропускной способности.

- Может использоваться для высокопроизводительных вычислений (HPC) прикладного и научного уровня: FP64/FP64 Tensor‑производительность, DPX‑инструкции, большая пропускная способность памяти и поддержка CUDA/OpenACC делают H100 NVL эффективным ускорителем для задач моделирования, биоинформатики, оптимизационных задач, финансовых расчётов и других compute‑интенсивных сценариев.

- Оптимален для высокоплотных AI‑кластеров и дата‑центров, где на одном узле размещают до 8 GPU H100 NVL, объединённых NVLink и высокоскоростными сетями, для построения фабрик LLM и генеративного ИИ, обслуживающих тысячи одновременных запросов.

- Подходит для мультимедийных и стриминговых сценариев, где требуются аппаратные декодеры: наличие до 14 NVDEC и 14 JPEG‑декодеров позволяет обрабатывать большое количество видеопотоков и изображений при подготовке данных и в задачах мультимодальных моделей.

Совместимость

NVIDIA H100 NVL 94GB спроектирован специально для интеграции в серверные платформы и NVIDIA‑сертифицированные системы, поддерживающие PCI Express Gen5, двухслотовые пассивно охлаждаемые ускорители и мощные подсистемы питания и охлаждения. В даташитах и описаниях партнёров подчёркивается, что H100 NVL предназначен для работы в составе систем с 1–8 GPU и требует корректной организации воздушного потока, чтобы работать в пределах TDP до 400W.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge — модели, входящие в перечень NVIDIA‑сертифицированных систем с поддержкой H100/H100 NVL и PCIe Gen5, включая конфигурации с 2–4 парами H100 NVL для задач LLM и генеративного ИИ.

- Проверена работа с серверами и системами HPE: в линейке HPE ProLiant и HPE Cray указываются опции NVIDIA H100 80GB PCIe и производные решения H100‑серии для AI и HPC, при этом H100 NVL 94GB интегрируется в те же архитектурные платформы с поддержкой PCIe Gen5, высоких TDP и соответствующей инфраструктуры питания и охлаждения.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro: в предложениях GPU‑серверов Supermicro H100 Nvidia и партнёрских конфигурациях для AI‑кластеров указываются системы с поддержкой H100‑серии, включая PCIe‑варианты, рассчитанные на использование H100 NVL 94GB и конфигураций 1–8 GPU на узел.

При проектировании систем с NVIDIA H100 NVL 94GB необходимо учитывать требования к электропитанию (TDP до 400 W на GPU, а в NVL‑связке — до 2× 350–400 W), к блокам питания и системе охлаждения, особенно в многокарточных конфигурациях. Документация NVIDIA и партнёров (Exalit, PrimeLine, Valdi и др.) предоставляет детальные рекомендации по размещению карт, ограничениям по количеству GPU на узел, минимальным требованиям к воздушному потоку и выбору серверных платформ, входящих в программу NVIDIA‑сертифицированных систем.

Инфраструктура и программная поддержка

NVIDIA H100 NVL 94GB интегрируется в программную экосистему NVIDIA для дата‑центров, включая CUDA, cuDNN, TensorRT, NCCL, Magnum IO и платформу NVIDIA AI Enterprise, которая доступна как опция для партнёрских систем с H100 NVL. Поддержка Multi‑Instance GPU (до 7 MIG по 12 GB на один ускоритель или до 14 MIG в NVL‑конфигурациях), а также широкий набор форматов (FP64, FP32, TF32, FP16, BF16, INT8, FP8) позволяет эффективно разделять ресурсы GPU между множеством рабочих нагрузок, арендаторов и сервисов.

Аппаратная поддержка конфиденциальных вычислений, многочисленных декодеров NVDEC/JPEG, богатый набор сертификатов и ориентация на NVIDIA‑сертифицированные серверные платформы Dell, HPE, Supermicro и других OEM‑партнёров делают NVIDIA H100 NVL 94GB ключевым ускорителем для построения современных кластеров генеративного ИИ, LLM‑платформ, HPC‑комплексов и дата‑центров, где критичны как производительность и масштабируемость, так и соответствие корпоративным требованиям к надёжности и безопасности.

подбор оборудования

до 90 дней