Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 13.03.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

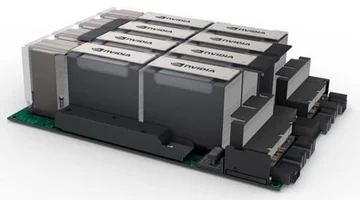

Видеокарта NVIDIA H200 141Gb ОЕМ 900-21010-0040-000 PCIe HBM3e

Гарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Лицензии

Описание

NVIDIA H200 NVL — это тензорный ускоритель нового поколения на архитектуре NVIDIA Hopper, специально разработанный для генеративного ИИ, инференса больших языковых моделей (LLM), обучения нейросетей и высокопроизводительных вычислений (HPC) в дата‑центрах. В официальных даташитах NVIDIA H200 Tensor Core GPU указывается, что H200 — первый в мире GPU с памятью HBM3e объёмом 141 ГБ и пропускной способностью до 4,8 ТБ/с, что почти вдвое больше по объёму и примерно в 1,4 раза выше по полосе памяти по сравнению с NVIDIA H100. Конфигурация H200 NVL в формате PCIe NVL‑ускорителя ориентирована на масштабируемые серверные платформы с несколькими GPU и поддержкой NVLink, обеспечивая высокую плотность ресурсов и эффективность в задачах LLM‑инференса и генеративных моделей.

В PNY / Azken NVIDIA H200 NVL Datasheet подчёркивается, что H200 «supercharges AI and HPC workloads» и обеспечивает до 4 петафлопс FP8‑производительности, до 2× ускорения LLM‑инференса и до 110× ускорения ряда HPC‑задач по сравнению с предыдущими поколениями. Ключевые характеристики, перечисленные в этих даташитах: 141GB of HBM3e GPU memory, 4.8TB/s of memory bandwidth, up to 4 PFLOPS of FP8 performance, up to 2× LLM inference performance и до 110× HPC performance. H200 NVL поставляется в виде пассивно охлаждаемой двухслотовой полноразмерной PCIe Gen5 карты с TDP до 700 Вт, поддерживает до 7 MIG‑экземпляров по 18 ГБ каждый (для SXM) или по 16–18 ГБ (для PCIe NVL‑варианта) и оснащён 7 аппаратными видеодекодерами NVDEC и 7 JPEG‑декодерами. Это делает H200 NVL универсальным ускорителем для кластеров генеративного ИИ и HPC.

Архитектура и ключевые характеристики

Архитектура NVIDIA H200 NVL основана на архитектуре NVIDIA Hopper, ориентированной на задачи ИИ и HPC, с упором на трансформерные модели и смешанную точность вычислений. В даташитах PNY и Megware описано, что H200 использует тензорные ядра четвёртого поколения с поддержкой форматов FP64, FP32, TF32, FP16, BF16, INT8, INT4 и FP8, реализуемого через Transformer Engine. Transformer Engine автоматически выбирает оптимальные форматы (FP8/FP16/FP32) для различных слоёв модели, что позволяет значительно ускорить обучение и инференс без существенной потери качества. В сводке SharonAI отмечается, что H200 удваивает производительность по сравнению с H100 в ряде задач генеративного ИИ, благодаря увеличенному объёму памяти HBM3e и более высокой полосе.

Подсистема памяти H200 NVL — ключевая особенность. В NVIDIA H200 NVL и общем H200 datasheet указывается: 141GB of HBM3e GPU memory и 4.8TB/s of memory bandwidth. Документ Elmark по NVIDIA H200 NVL GPU содержит таблицу, где указано: ширина шины памяти 6 016 bits и peak memory bandwidth 4 813 GB/s (≈4,8 ТБ/с), что подтверждает параметры подсистемы памяти. Сайт h200.info в спецификациях для H200 приводит те же значения: 141 GB HBM3e, 4.8 TB/s, 1.9× ускорение Llama 2 70B и 1.6× ускорение GPT‑3 175B инференса по сравнению с H100. Такая конфигурация памяти позволяет размещать в пределах одного GPU значительно более крупные модели и контексты, снижая потребность в агрессивном разбиении модели по нескольким ускорителям.

По вычислительной производительности PNY / Azken H200 NVL Datasheet приводит ключевые показатели: FP8 Tensor Core — до 4 PFLOPS (4 petaFLOPS of FP8 performance), INT8 Tensor Core — до 3 958 TFLOPS (с учётом sparsity), при этом количество декодеров составляет 7 NVDEC и 7 JPEG. Расширенный фрагмент Datasheet PNY показывает численные значения: 1 979 TFLOPS и 3 958 TFLOPS для различных режимов FP8/INT8 (без и с sparsity), 141GB HBM3e, 4.8TB/s, «Up to 700W (configurable)», «Up to 7 MIGs @18GB each», «SXM / PCIe Gen5». На SharonAI дополнительно подчёркивается, что H200 поддерживает до 7 MIG‑экземпляров по 18 GB, аппаратное Confidential Computing и стандартный набор декодеров NVDEC/JPEG.

Форм‑фактор H200 NVL графической карты описан как «Passive, dual-slot, full-height PCIe Gen5» с TDP до 700W. NetworkOutlet для NVIDIA H200 NVL Tensor Core GPU указывает: Memory 141GB HBM3e, Memory Bandwidth 4.8 TB/s, Interface PCI Express 5.0 x16, Cooling Passive (requires adequate system airflow), Form Factor Dual-slot, full-height, TDP 700W, Multi-GPU Support NVLink, Decoders 7 NVDEC, 7 JPEG. Newegg для NVIDIA H200 NVL Graphic Card 141 GB также подтверждает: Memory Size 141GB, Memory Type HBM3e, Memory Bandwidth 4.8TB/s, Cooling System Passive Cooling, TDP 700W. Это подчёркивает серверную ориентированность и необходимость использования H200 NVL в шасси с продуманным воздушным потоком.

Программная и функциональная архитектура H200 NVL включает поддержку SR‑IOV, Multi‑Instance GPU (до 7 MIG), аппаратного Confidential Computing, а также стандартных compute‑API: CUDA, DirectCompute, OpenCL, OpenACC — что явно указано в спецификациях H200 NVL у ряда дистрибьюторов и в документах уровня datasheet. Таким образом, H200 NVL сочетает в себе архитектуру Hopper, HBM3e, NVLink и современные программные возможности NVIDIA, обеспечивая существенный прирост производительности для ИИ и HPC.

Сценарии применения

NVIDIA H200 NVL ориентирован на эксплуатацию в наиболее ресурсоёмких сценариях генеративного ИИ, работы с LLM‑моделями, глубокого обучения и высокопроизводительных вычислений, где требуется большая видеопамять, высокая пропускная способность и масштабируемость. Архитектура Hopper, память HBM3e, FP8‑производительность и NVLink делают этот ускоритель основой для современных AI‑кластеров и фабрик данных.

- Идеально подходит для обучения нейросетей (Deep Learning) крупного и сверхкрупного масштаба: 141 GB HBM3e и 4,8 TB/s позволяют обучать большие трансформерные, мультимодальные и diffusion‑модели с крупными батчами и длинным контекстом, минимизируя необходимость шардирования моделей по нескольким GPU.

- Подходит для инференса LLM‑моделей, включая GPT‑класса и Llama‑подобные модели: официальные сравнительные данные показывают до 2× LLM inference performance (до 1,9× ускорения Llama2 70B и до 1,6× ускорения GPT‑3 175B по сравнению с H100), а поддержка FP8/INT8 и MIG позволяет обслуживать большое количество параллельных сессий с низкой задержкой.

- Может использоваться для высокопроизводительных вычислений (HPC): до 110× ускорения некоторых HPC‑нагрузок, FP64/FP32‑производительность, HBM3e и NVLink делают H200 NVL эффективным для задач численного моделирования, биоинформатики, климатического и физического моделирования, CFD и финансовых расчётов.

- Оптимален для аналитики больших данных и конвергентных нагрузок ИИ+HPC, где в едином кластере выполняются ETL, классический ML, глубокое обучение и инференс, используя библиотеки CUDA‑экосистемы и платформу NVIDIA AI Enterprise.

- Подходит для построения фабрик ИИ и LLM‑кластеров с несколькими GPU на узел, где H200 NVL в форм‑факторе PCIe Gen5 используется в конфигурациях 2–4 GPU с NVLink‑мостами и масштабируется через NVIDIA‑сертифицированные системы до 8 и более GPU на сервер.

Совместимость

NVIDIA H200 NVL спроектирован для работы в современных серверных платформах с поддержкой PCI Express Gen5, мощных подсистем питания и охлаждения, а также входит в состав NVIDIA‑сертифицированных систем ведущих OEM‑производителей. Пассивное охлаждение и TDP до 700W требуют серверных корпусов с направленным воздушным потоком и тщательной проработкой термопрофиля.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge — в рамках решений на базе H200 для ИИ и нейросетей, где используются NVIDIA H200 NVL PCIe в конфигурациях 2–4 GPU на узел с поддержкой NVLink; такие системы описываются в NVIDIA Certified Systems и партнёрских материалах для Dell.

- Проверена работа с серверами и системами HPE: официальный документ «NVIDIA H200 NVL 141GB PCIe Accelerator for HPE» подтверждает поддержку H200 NVL 141GB в платформах HPE ProLiant ML/DL Gen11 и ряде Gen10 Plus серверов, предназначенных для задач генеративного ИИ, LLM и HPC.

- Ускоритель протестирован на совместимость с серверными платформами Supermicro: решения Supermicro HGX/HGX‑совместимые и NVIDIA MGX H200 NVL partner используют H200 NVL PCIe в конфигурациях 4–8 GPU на узел, о чём говорится в описаниях Supermicro H200 GPU Server и у дистрибьюторов, предлагающих платы «Nvidia H200 NVL Graphic Card 141 GB Passive PCIe».

При проектировании систем с H200 NVL необходимо учитывать требования к электропитанию (до 700W на ускоритель), наличию PCIe Gen5 x16, NVLink‑мостов для многокарточных конфигураций, а также к воздушному потоку в шасси (пассивное охлаждение требует достаточно мощной системы вентиляции). Документация HPE, Lenovo, NVIDIA MGX и партнёрские datasheet‑материалы описывают поддерживаемые серверы, ограничения по количеству GPU на узел, минимальные требования к блокам питания и конфигурации вентиляторов, что гарантирует предсказуемую и надёжную эксплуатацию H200 NVL в производственных средах.

Инфраструктура и программная поддержка

NVIDIA H200 NVL полностью интегрируется в программную экосистему NVIDIA для дата‑центров: CUDA, cuDNN, TensorRT, NCCL, Magnum IO и NVIDIA AI Enterprise, что позволяет использовать его с популярными фреймворками (PyTorch, TensorFlow и др.) и оркестрационными платформами для обучения и инференса моделей любого масштаба. Поддержка Multi‑Instance GPU (до 7 MIG @18GB для H200) позволяет делить один физический ускоритель на несколько логических GPU с гарантированной изоляцией и QoS, что особенно важно для мультиарендных и облачных платформ.

Аппаратная поддержка Confidential Computing, наличие 7 NVDEC и 7 JPEG‑декодеров, SR‑IOV и широкий набор корпоративных сертификаций делают NVIDIA H200 NVL ключевым ускорителем для построения современных кластеров генеративного ИИ, LLM‑платформ, HPC‑комплексов и дата‑центров, где критичны высокая производительность, масштабируемость и совместимость с серверными платформами Dell, HPE, Supermicro и другими OEM‑партнёрами.

подбор оборудования

до 90 дней