Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 27.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

Видеокарта NVIDIA Tesla V100 32GB PCIe HBM2

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость с NVIDIA Tesla V100 32GB PCIe HBM2

Лицензии

Описание

NVIDIA Tesla V100 PCIe 32GB — это тензорный GPU-ускоритель дата-центрового класса на архитектуре NVIDIA Volta, предназначенный для задач глубокого обучения, инференса, высокопроизводительных вычислений (HPC) и аналитики данных в серверах с интерфейсом PCI Express 3.0 x16. В официальных материалах Tesla V100 описывается как ускоритель, сочетающий 5120 ядер CUDA, 640 тензорных ядер и 32 ГБ высокоскоростной памяти HBM2 с пропускной способностью порядка 897–900 ГБ/с, что даёт значительный прирост производительности по сравнению с предыдущим поколением Pascal. Форм-фактор PCIe — полноразмерная двухслотовая карта с пассивным охлаждением и TDP около 250 Вт, рассчитанная на установку в стандартные серверные шасси с направленным воздушным потоком. В документации подчёркивается, что версия на 32 ГБ предназначена для сценариев, где критичны объём памяти и пропускная способность: обучение крупных моделей, задачи HPC, чувствительные к объёму и скорости памяти, а также приложения, работающие с большими наборами данных.

Архитектура и ключевые характеристики

Согласно даташиту NVIDIA Tesla V100 GPU Accelerator и обновлённому описанию V100 Tensor Core GPU, ускоритель основан на графическом процессоре GV100 архитектуры Volta, выполненном по 12‑нм техпроцессу и содержащем более 21 млрд транзисторов. GPU включает до 80 SM (Streaming Multiprocessor), что суммарно даёт 5120 ядер CUDA и 640 тензорных ядер, ориентированных на аппаратное ускорение матричных операций и свёрток в задачах глубокого обучения. Для варианта PCIe в официальных спецификациях указывается пиковая производительность порядка 7 TFLOPS в двойной точности (FP64), около 14 TFLOPS в одинарной точности (FP32) и до 112 TFLOPS в тензорных операциях (FP16 с накоплением в FP32). Архитектура Volta реализует переработанную структуру SM, увеличенные кеши L1/L2 и поддержку одновременного выполнения целочисленных и плавающих операций, что повышает эффективность сложных смешанных AI/HPC-нагрузок.

Подсистема памяти Tesla V100 PCIe 32GB реализована на базе 32 ГБ памяти HBM2, размещённой по технологии CoWoS и подключённой по 4096‑битному интерфейсу. В спецификациях приводится эффективная частота порядка 876 МГц, что даёт суммарную пропускную способность около 897–900 ГБ/с на плату. По данным HPE NVIDIA Tesla V100 PCIe 32GB Computational Accelerator, объём памяти на плату составляет 32 ГБ HBM2, а заявленная пропускная способность — 900 ГБ/с, что напрямую указано в таблице характеристик. Память поддерживает ECC, обеспечивая обнаружение и коррекцию одиночных ошибок и обнаружение более сложных сбоев, что критично для многосуточных вычислительных серий и обучения крупных моделей.

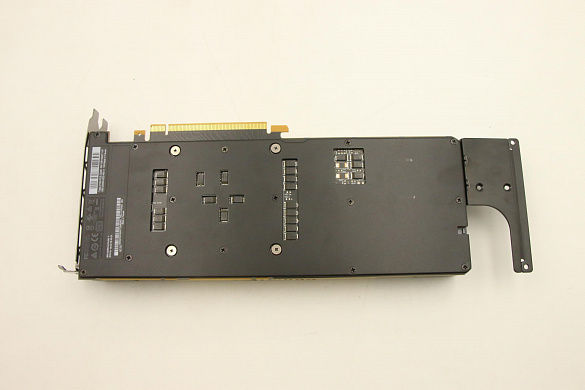

Физически Tesla V100 PCIe 32GB представляет собой полноразмерную двухслотовую карту PCIe 3.0 x16 с пассивным охлаждением и двумя 8‑контактными разъёмами питания, при этом TDP составляет около 250 Вт. В разделе «Form factor & compatibility» указано, что карта имеет интерфейс PCIe 3.0 x16, ширину 2 слота и требует два 8‑контактных разъёма питания, что важно при проектировании серверных конфигураций. В продуктовых описаниях дополнительно подчёркивается поддержка стандартных API CUDA и OpenACC, а также библиотек для глубокого обучения, что облегчает перенос существующих приложений и моделей на GPU. Конфигурация на 32 ГБ специально выделяется как ориентированная на сценарии, ограниченные объёмом памяти (memory capacity‑bound HPC и AI), о чём прямо говорится в описании HPE NVIDIA Tesla V100 32GB.

Сценарии применения

В документации NVIDIA и OEM‑поставщиков Tesla V100 PCIe 32GB позиционируется как высокопроизводительный тензорный ускоритель для ключевых задач искусственного интеллекта и HPC, где критичны не только производительность, но и объём памяти на один GPU. Удвоенный по сравнению с 16‑гигабайтной версией объём HBM2 (32 ГБ) в сочетании с пропускной способностью около 900 ГБ/с делает карту особенно востребованной для крупных моделей и задач, чувствительных к объёму видеопамяти.

- Идеально подходит для обучения нейросетей (Deep Learning), в том числе крупных сверточных сетей, трансформеров и гибридных архитектур, где 32 ГБ HBM2 позволяют размещать большие модели и батчи целиком в памяти ускорителя, а тензорные ядра Volta обеспечивают до 112 TFLOPS в тензорных операциях.

- Подходит для инференса LLM моделей и других задач обработки естественного языка (NLP), когда используются модели с большим числом параметров и требуется сочетание объёма памяти, высокой пропускной способности и возможности развертывания в стандартных PCIe‑совместимых серверных платформах.

- Ориентирована на высокопроизводительные вычисления (HPC), ограниченные объёмом памяти: задачи вычислительной гидродинамики (CFD), моделирование материалов, квантовая химия, FEM и другие сценарии, где в описании HPE V100 32GB прямо указывается класс «Memory Capacity‑Bound HPC» наряду с Compute‑bound HPC.

- Используется в аналитике данных и машинном обучении (ML), включая рекомендательные системы, анализ больших массивов данных и графовые модели, где GPU ускоряет вычисления по сравнению с CPU‑только решениями и позволяет работать с увеличенными наборами признаков за счёт 32 ГБ памяти.

- Подходит для построения гибридных кластеров CPU+GPU и высокопроизводительных рабочих станций, где Tesla V100 PCIe 32GB выступает вычислительным сопроцессором, а существующие коды ускоряются при помощи CUDA и OpenACC без радикальной переработки алгоритмов.

- Применяется в исследовательских и академических проектах, ориентированных на разработку и тестирование новых моделей ИИ и HPC‑методов, где важно сочетание большой памяти, производительности и совместимости с широким спектром серверных платформ.

Совместимость

Ускоритель NVIDIA Tesla V100 PCIe 32GB реализован в виде двухслотовой карты PCI Express 3.0 x16 с пассивным охлаждением и TDP около 250 Вт, что требует использования серверных платформ с поддержкой полноразмерных GPU и двумя 8‑контактными разъёмами питания. Для корректной работы необходим направленный воздушный поток в шасси, предназначенный для охлаждения пассивных GPU‑ускорителей, о чём также говорится в OEM‑документации HPE и других производителей.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge, что подтверждается включением Tesla V100 PCIe в GPU‑оптимизированные конфигурации Dell и в перечни серверов, рассчитанных на установку нескольких V100 в одном шасси; такие конфигурации упоминаются в документации по GPU‑серверам и в сертификационных материалах NVIDIA.

- Поддерживается в системах HPE, включая HPE ProLiant и HPE Apollo, где в документе HPE NVIDIA Tesla V100 PCIe 32GB Computational Accelerator ускоритель указан как совместимый продукт, а также описаны возможности мониторинга и конфигурирования через HPE Insight Cluster Management Utility (CMU).

- Совместим с серверными платформами Supermicro, о чём свидетельствуют материалы Supermicro и партнёров: GPU‑оптимизированные системы Supermicro поддерживают установку нескольких Tesla V100 PCIe, что подчёркивается в описаниях систем с 8 ускорителями V100 и NVLink‑связанными конфигурациями.

- Может использоваться и в других серверных системах, соответствующих требованиям по интерфейсу PCIe 3.0 x16, форм-фактору FHFL dual-slot, наличию двух 8‑контактных разъёмов питания и обеспечению необходимого воздушного потока, как указано в продуктовом бріфе Tesla V100 PCIe GPU Accelerator и OEM‑даташитах.

Надёжность и эксплуатация в ЦОД

В официальных даташитах и материалах по Volta подчёркивается, что NVIDIA Tesla V100 PCIe 32GB рассчитана на круглосуточную эксплуатацию в центрах обработки данных и высокопроизводительных вычислительных кластерах, где критичны стабильность, предсказуемое энергопотребление и отказоустойчивость. Поддержка ECC для памяти HBM2 и встроенные механизмы контроля ошибок в вычислительных блоках уменьшают риск искажения данных и делают ускоритель подходящим для многосуточных вычислительных задач и критически важных приложений. В документах HPE и других OEM‑производителей также отмечается возможность мониторинга состояния GPU (температура, загрузка, ошибки) и управления драйверами и CUDA‑стеком через специализированные утилиты управления кластерами.

Форм-фактор PCIe FHFL dual-slot с пассивным охлаждением и TDP около 250 Вт подразумевает использование в GPU‑оптимизированных серверах с тщательно спроектированной системой вентиляции, что отражено в спецификациях OEM‑систем Dell, HPE, Supermicro и других производителей. Поддержка стандартных API (CUDA, OpenACC, библиотеки для глубокого обучения и HPC) и наличие сертифицированных или рекомендованных OEM‑конфигураций упрощают развёртывание и масштабирование решений на базе Tesla V100 PCIe 32GB в корпоративных и научных ЦОД. В совокупности архитектура Volta с тензорными ядрами, 32 ГБ HBM2, высокая производительность в FP16/FP32/FP64, форм-фактор PCIe и поддержка ведущих OEM делают NVIDIA Tesla V100 PCIe 32GB надёжной и универсальной основой для инфраструктур глубокого обучения, инференса LLM и высокопроизводительных вычислений в современных центрах обработки данных.

подбор оборудования

до 90 дней