Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 02.04.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

GPU‑сервер NVIDIA с 8 ускорителями NVIDIA H200 (SXM)

Гарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Лицензии

Отсрочка платежа

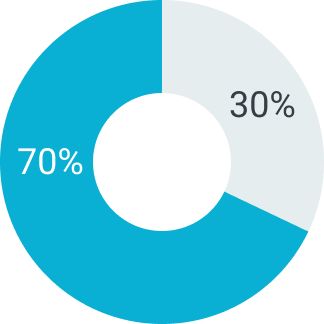

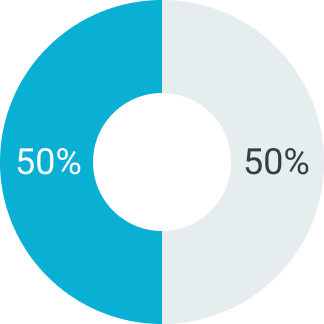

В зависимости от суммы поставляемого товара можем предоставить отсрочку платежа на срок от 5 до 90 дней. Условия отсрочки платежа рассматриваются индивидуально. Подробную информацию уточняйте у вашего менеджера.

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Описание

GPU‑сервер NVIDIA с 8 ускорителями NVIDIA H200 (SXM) представляет собой передовое вычислительное решение, созданное для интенсивных задач искусственного интеллекта, глубокого обучения и высокопроизводительных научных вычислений. Оснащённый восемью графическими процессорами NVIDIA H200 с 141 ГБ памяти HBM3e на каждый и пропускной способностью до 4,8 ТБ/с, сервер обеспечивает исключительную производительность и масштабируемость для обучения крупных AI-моделей и инференса в современных дата-центрах и вычислительных кластерах.

Архитектура NVIDIA H200 и ключевые особенности сервера

Ускорители NVIDIA H200 построены на архитектуре Hopper с использованием 4-нм техпроцесса и включают 456 тензорных ядер четвёртого поколения, обеспечивающих высокую точность и производительность благодаря поддержке новейших числовых форматов FP8 и FP16. Каждый GPU оснащён 141 ГБ памяти HBM3e с пропускной способностью до 4,8 ТБ/с. Топология NVLink 5.0 и NVSwitch обеспечивает высокоскоростное соединение между восемью GPU с пропускной способностью до 900 ГБ/с, что минимизирует задержки при обмене данными и способствует масштабируемой параллельной обработке вычислений.

Технология Multi-Instance GPU (MIG) позволяет разделить каждый ускоритель на до 7 виртуальных инстансов, что повышает гибкость и эффективность распределения ресурсов.

Инфраструктура, программное обеспечение и сферы применения

Сервер NVIDIA с 8 H200 SXM поддерживает современные технологии дата-центров, включая NVMe SSD и высокопроизводительные сетевые интерфейсы InfiniBand и Ethernet со скоростью до 400 Гбит/с. Он совместим с программным стеком NVIDIA AI Enterprise, включающим CUDA, TensorRT, Triton, а также основными AI-фреймворками такими как PyTorch, TensorFlow и DeepSpeed. Это делает сервер оптимальным выбором для масштабируемого обучения языковых моделей, генеративного ИИ, HPC и научных исследований.

- 8 ускорителей NVIDIA H200 SXM с 141 ГБ памяти HBM3e каждый

- Пропускная способность памяти до 4,8 ТБ/с на GPU

- NVLink 5.0 и NVSwitch с пропускной способностью до 900 ГБ/с

- Поддержка Multi-Instance GPU (MIG) для эффективной виртуализации ресурсов

- Высокоскоростные сетевые интерфейсы InfiniBand и Ethernet

- Совместимость с NVIDIA AI Enterprise и ведущими AI-фреймворками

- Идеальное решение для масштабируемого обучения, инференса и HPC задач

подбор оборудования

до 90 дней