Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 07.03.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

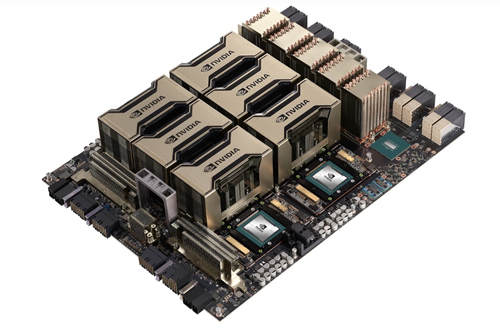

Серверная платформа NVIDIA HGX A100 4-GPU

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Комплектующие для NVIDIA HGX A100 4-GPU

Совместимость

Лицензии

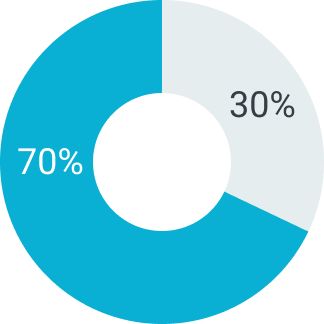

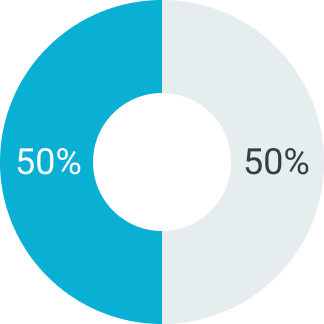

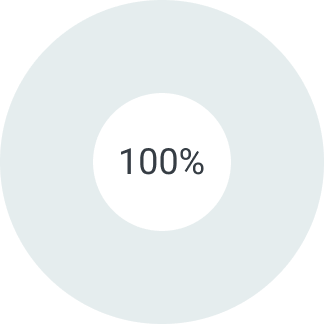

Отсрочка платежа

В зависимости от суммы поставляемого товара можем предоставить отсрочку платежа на срок от 5 до 90 дней. Условия отсрочки платежа рассматриваются индивидуально. Подробную информацию уточняйте у вашего менеджера.

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Описание

Серверная платформа NVIDIA HGX A100 с четырьмя графическими ускорителями A100 — это высокопроизводительная платформа, предназначенная для выполнения задач нового поколения в области искусственного интеллекта, машинного обучения, моделирования, научных вычислений и аналитики. Построенная на флагманской архитектуре NVIDIA Ampere, HGX A100 предлагает исключительную вычислительную плотность и гибкость для широкого спектра корпоративных и научных задач. Благодаря интеграции четырёх ускорителей NVIDIA A100, объединённых высокоскоростной межсвязью NVLink и NVSwitch, серверная платформа обеспечивает беспрецедентную пропускную способность и низкие задержки при обмене данными между GPU. Это решение идеально подходит для развертывания в современных ЦОДах, высокопроизводительных кластерах, суперкомпьютерных системах и инфраструктурах, требующих высокой слаженности между графическими ускорителями. Серверная платформа HGX A100 помогает компаниям ускорить научные открытия, улучшить точность прогнозов и оптимизировать производственные процессы за счёт ИИ и симуляций.

Архитектура Ampere и вычислительная мощность A100

Каждый ускоритель NVIDIA A100, входящий в состав серверной платформы, построен на архитектуре Ampere и оснащён 40 ГБ или 80 ГБ памяти HBM2e, что обеспечивает сверхвысокую пропускную способность — до 2 ТБ/с. Эти GPU поддерживают широкий спектр форматов данных: FP64, FP32, TF32, FP16, INT8, а также инновационный формат с переменной точностью — sparsity-aware. Такая гибкость позволяет адаптировать серверную платформу под конкретные задачи: от обучения больших языковых моделей (LLM) и генеративных нейросетей до численного моделирования и инженерных симуляций в реальном времени.

Система HGX обеспечивает тесную связку всех четырёх GPU благодаря встроенному NVSwitch, который создаёт единую высокоскоростную коммуникационную матрицу. Это значит, что каждый ускоритель может напрямую и с минимальными задержками обращаться к памяти любого другого ускорителя в системе. Такой подход устраняет узкие места при обмене данными между GPU, особенно при распределённом обучении моделей, сложных симуляциях или параллельной аналитике. Технология Multi-Instance GPU (MIG) позволяет разделять каждый A100 на несколько изолированных экземпляров, обеспечивая многопользовательскую работу с максимальной эффективностью и без конфликта ресурсов.

Серверная платформа HGX A100 полностью совместима с программной экосистемой NVIDIA AI и поддерживает такие инструменты, как CUDA, cuDNN, TensorRT, RAPIDS, NCCL, Triton Inference Server и NGC-контейнеры. Это делает ее готовой к развертыванию в самых разнообразных сценариях: от обучения нейросетей и обработки видео до запуска сервисов предиктивной аналитики и построения цифровых двойников.

Инфраструктурная совместимость и ключевые преимущества

Платформа NVIDIA HGX A100 4-GPU предназначена для гибкой интеграции в дата-центры и масштабируемые HPC-кластеры. Серверная платформа может быть установлена в 2U или 4U корпус, в зависимости от конфигурации, и поддерживает горячую замену компонентов, резервируемое питание и интеллектуальное охлаждение. Такое сочетание характеристик делает ее идеальным выбором для долгосрочных проектов с высокой нагрузкой и критичными требованиями к стабильности.

- 4 ускорителя NVIDIA A100 (по 40 ГБ или 80 ГБ HBM2e)

- Общая пропускная способность межсвязи NVSwitch до 600 ГБ/с

- Поддержка TF32, FP64, FP16, INT8, sparsity-aware вычислений

- Multi-Instance GPU (MIG) — до 28 виртуальных GPU на сервер

- Совместимость с экосистемой NVIDIA AI, включая TensorFlow, PyTorch, MXNet

- Поддержка PCIe Gen4, NVLink, NVSwitch и InfiniBand сетей

- Оптимизировано для кластеров DGX SuperPOD и облачных инфраструктур

Такая система находит применение в научных учреждениях, медицинских исследовательских центрах, аэрокосмической промышленности, энергетике, биоинформатике, финансовом моделировании и автономных системах. HGX A100 используется для построения цифровых двойников, анализа сложных физических процессов, обучения трансформеров, прогнозирования временных рядов и обработки массивов данных в реальном времени. Это серверная платформа, которая позволяет компаниям реализовать амбициозные идеи и выйти на новый уровень эффективности, качества и скорости внедрения искусственного интеллекта в бизнес и науку.

Сферы применения NVIDIA HGX A100

- Обучение и инференс крупных ИИ-моделей

- Высокопроизводительные вычисления (HPC)

- Обработка больших данных

- Научное моделирование и симуляции

- ИИ в здравоохранении и нефтегазе

- Обработка видео и изображений

- Интеграция в суперкомпьютеры и дата-центры

подбор оборудования

до 90 дней