Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 06.03.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

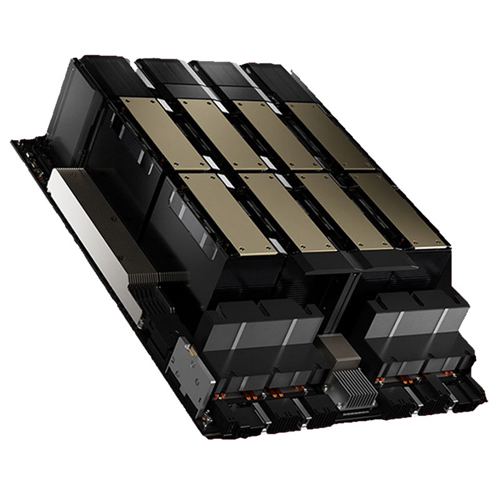

Серверная платформа NVIDIA HGX H20 8-GPU

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

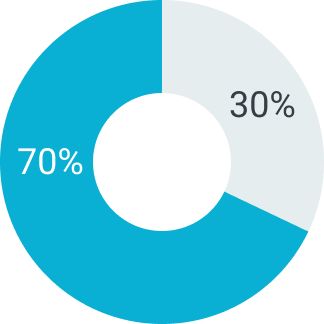

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Комплектующие для NVIDIA HGX H20 8-GPU

Лицензии

Отсрочка платежа

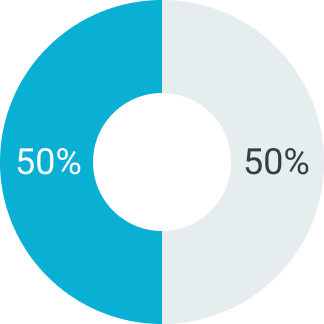

В зависимости от суммы поставляемого товара можем предоставить отсрочку платежа на срок от 5 до 90 дней. Условия отсрочки платежа рассматриваются индивидуально. Подробную информацию уточняйте у вашего менеджера.

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Описание

Серверная платформа NVIDIA HGX H20 с восемью графическими ускорителями H20 представляет собой высокопроизводительное решение для вычислений в сфере искусственного интеллекта, анализа больших данных и научного моделирования. Эта платформа создана на базе архитектуры NVIDIA Hopper и адаптирована под экспортные ограничения, действующие в ряде стран, включая Китай. Несмотря на ограничения, HGX H20 сохраняет основные технологии, применяемые в флагманских решениях NVIDIA, включая поддержку трансформеров, технологию Multi-Instance GPU, аппаратное ускорение инференса и совместимость с широким спектром ИИ-фреймворков. Серверная платформа оптимальна для развёртывания в корпоративных ЦОДах, исследовательских кластерах, государственном секторе и облачных инфраструктурах, где требуется масштабируемая производительность, надёжность и соответствие локальным нормативным требованиям.

Вычислительная архитектура и графические ускорители H20

В основе серверной платформы HGX H20 находятся восемь графических ускорителей NVIDIA H20, созданных на архитектуре Hopper — той же, что используется в H100 и H200. Каждый GPU оснащён 96 ГБ высокоскоростной памяти HBM3, обеспечивающей необходимую пропускную способность для работы с нейросетями большого масштаба, в том числе трансформерами и мультимодальными моделями. Это особенно важно при обучении и инференсе моделей LLM, генеративных ИИ-систем и систем предиктивной аналитики.

Технология Transformer Engine позволяет эффективно ускорять обучение моделей, автоматически переключаясь между форматами FP8 и FP16, в зависимости от уровня сложности операции и необходимой точности. Это обеспечивает значительный прирост производительности при сохранении точности расчётов. Также поддерживаются форматы FP64, TF32 и INT8, что делает ускорители универсальными для широкого спектра вычислительных задач — от анализа временных рядов и видео до численного моделирования в научной среде.

Система поддерживает функцию Multi-Instance GPU (MIG), позволяя делить каждый ускоритель на несколько изолированных экземпляров. Это особенно полезно для развёртывания в мультиарендных средах, создания виртуальных рабочих пространств и запуска множества независимых ИИ-задач параллельно. Межграфическая связь организована с помощью адаптированной версии NVLink и NVSwitch, обеспечивающей высокую пропускную способность при обмене данными между GPU. Такая архитектура снижает задержки и повышает эффективность распределённых вычислений внутри одного узла.

Интеграция, надёжность и прикладное применение

Серверная платформа HGX H20 8-GPU спроектирована для размещения в стойках высокой плотности и подходит для круглосуточной работы в условиях интенсивной загрузки. Она поддерживает резервирование питания, интеллектуальное охлаждение и интеграцию в отказоустойчивые инфраструктуры. Благодаря интерфейсам PCIe Gen4, поддержке GPUDirect и сетей InfiniBand, серверная платформа легко подключается к системам хранения, другим узлам в кластере и высокоскоростным сетевым инфраструктурам.

- 8 ускорителей NVIDIA H20, по 96 ГБ HBM3 на каждом GPU

- Архитектура Hopper с Transformer Engine и поддержкой FP8 / FP16

- Multi-Instance GPU (до 56 виртуальных GPU на один сервер)

- Поддержка форматов TF32, FP64, INT8 для гибкой настройки под задачи

- МежGPU-коммуникация через NVLink / NVSwitch (адаптированная)

- Совместимость с CUDA, TensorRT, cuDNN, NCCL и Triton Inference Server

- Поддержка фреймворков: PyTorch, TensorFlow, JAX, DeepSpeed, Megatron

HGX H20 находит применение в самых разнообразных сферах — от государственного сектора и телекоммуникаций до научных лабораторий и корпоративных аналитических систем. Он идеально подходит для обучения и вывода языковых моделей, генерации изображений и видео, симуляций физических процессов, моделирования поведения систем и создания цифровых двойников. Благодаря адаптации под экспортные ограничения и сохранению ключевых вычислительных возможностей, NVIDIA HGX H20 8-GPU предоставляет организациям мощную, гибкую и надёжную платформу для масштабирования искусственного интеллекта — даже в условиях ограниченного доступа к высокопроизводительным технологиям.

Сферы применения NVIDIA HGX H20

- Обучение и инференс ИИ-моделей

- Высокопроизводительные вычисления (HPC)

- Анализ больших данных

- Моделирование и симуляции

- Обработка видео и изображений

- Суперкомпьютерные кластеры

подбор оборудования

до 90 дней