Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 30.04.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

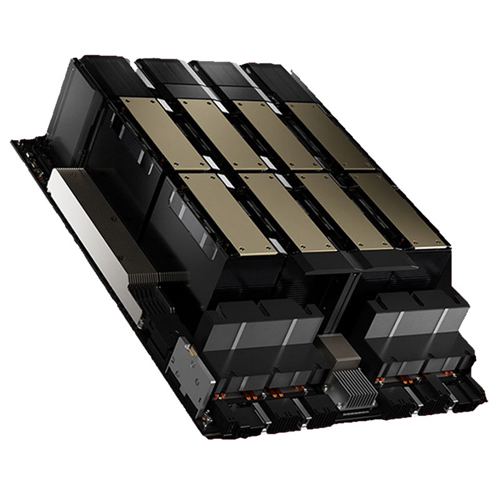

Серверная платформа NVIDIA HGX H800 8-GPU

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Комплектующие для NVIDIA HGX H800 8-GPU

Лицензии

Отсрочка платежа

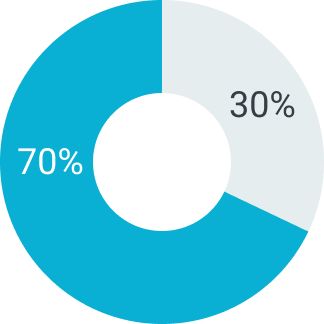

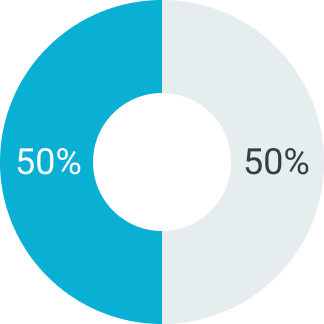

В зависимости от суммы поставляемого товара можем предоставить отсрочку платежа на срок от 5 до 90 дней. Условия отсрочки платежа рассматриваются индивидуально. Подробную информацию уточняйте у вашего менеджера.

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Описание

Серверная платформа NVIDIA HGX H800 с восемью графическими ускорителями H800 — это высокопроизводительное вычислительное решение, предназначенное для обработки задач искусственного интеллекта, глубокого обучения, машинного зрения, анализа больших данных и научного моделирования. Являясь адаптированной версией платформы HGX H100, модель H800 разработана специально для использования на китайском рынке, с учётом ограничений на экспорт передовых технологий. Тем не менее, HGX H800 сохраняет ключевые преимущества архитектуры NVIDIA Hopper, включая масштабируемость, энергоэффективность, поддержку генеративных нейросетей и крупных языковых моделей. Благодаря оптимизации под трансформеры, тесной межсвязи между GPU и высокой пропускной способности памяти, серверная платформа HGX H800 8-GPU обеспечивает отличную вычислительную плотность и надёжную основу для развёртывания ИИ-кластеров, облачных ИИ-сервисов и научных платформ.

Ускорители H800: архитектура Hopper и масштабируемая производительность

Графические ускорители NVIDIA H800 построены на базе той же архитектуры Hopper, что и оригинальные H100, и сохраняют многие архитектурные особенности, включая поддержку Transformer Engine, работу с новыми форматами данных и эффективное масштабирование в многографических конфигурациях. Каждый GPU H800 оснащён 80 ГБ памяти HBM3 с высокой пропускной способностью, оптимальной для задач с интенсивной загрузкой памяти — таких как обучение трансформеров, генерация контента, инференс и рендеринг.

Ускорители H800 поддерживают современные числовые форматы FP64, TF32, FP16, INT8, а также ключевую функцию Transformer Engine с возможностью автоматического переключения между форматами FP8 и FP16 в зависимости от этапа обработки и конфигурации модели. Это позволяет значительно повысить производительность при работе с LLM, мультимодальными ИИ и генеративными архитектурами, обеспечивая сокращение времени обучения при сохранении точности. Технология Multi-Instance GPU (MIG) позволяет делить каждый GPU на изолированные логические блоки, что обеспечивает эффективное использование ресурсов и поддержку многопользовательской среды.

Вся восьмиграфическая конфигурация соединена через NVSwitch с использованием NVLink (адаптированного для H800), что обеспечивает плотную межGPU-коммуникацию с высокой пропускной способностью. Это особенно важно для синхронизации весов и параметров при обучении масштабируемых моделей. Серверная платформа HGX H800 оптимизирована для параллельных вычислений, инференса и масштабного обучения, поддерживает работу с популярными ИИ-фреймворками, включая PyTorch, TensorFlow, Megatron, JAX, DeepSpeed и другие.

Инфраструктура, интеграция и ключевые сферы применения

HGX H800 8-GPU — это платформа, способная стать основой как для корпоративных ЦОДов, так и для государственных ИИ-инициатив. Серверная платформа поддерживает современные стандарты подключения, включая PCIe Gen4, InfiniBand и GPUDirect RDMA, обеспечивая эффективную работу с хранилищами данных, сетями и распределёнными ИИ-кластерами. Она предназначен для размещения в стойках высокой плотности, предлагает эффективную систему охлаждения, резервируемое питание и может масштабироваться от одной системы до сверхмасштабируемых вычислительных ферм.

- 8 GPU NVIDIA H800 с 80 ГБ HBM3 каждый

- Архитектура NVIDIA Hopper с поддержкой Transformer Engine

- Поддержка TF32, FP16, FP8, INT8, FP64

- Технология Multi-Instance GPU (MIG) — до 56 виртуальных GPU

- Полносвязная архитектура NVLink + NVSwitch (адаптированная)

- Совместимость с CUDA, cuDNN, NCCL, TensorRT, Triton

- Интеграция с PyTorch, TensorFlow, Megatron, DeepSpeed

Серверная платформа HGX H800 8-GPU находит применение в самых передовых задачах: от обучения больших языковых моделей и систем рекомендаций до медицинской диагностики, автономного вождения, финансового моделирования и научных симуляций. Он подходит для построения облачных ИИ-платформ, рендер-ферм, ИИ-as-a-Service, платформ анализа данных в режиме реального времени и многопользовательских обучающих сред. Благодаря адаптации под китайскую ИТ-инфраструктуру, HGX H800 стал ключевым элементом в реализации крупных национальных ИИ-проектов и корпоративных систем цифрового интеллекта. Это серверная платформа, обеспечивающая реальное масштабирование и надёжную основу для развёртывания ИИ следующего поколения.

Сферы применения NVIDIA HGX H800

- Обучение и инференс ИИ-моделей

- HPC и научные вычисления

- Анализ больших данных

- Моделирование и симуляции

- Обработка видео и изображений

- Суперкомпьютерные кластеры

подбор оборудования

до 90 дней