Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 05.04.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

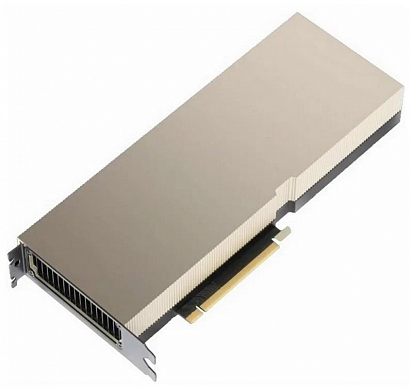

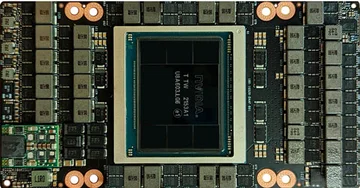

Видеокарта NVIDIA H800 80GB SXM5

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

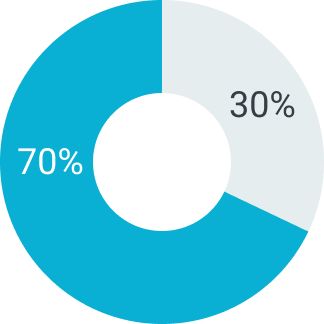

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Лицензии

Соберите свою конфигурацию

Отсрочка платежа

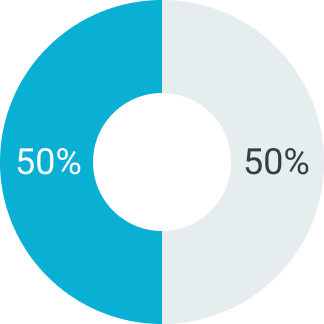

В зависимости от суммы поставляемого товара можем предоставить отсрочку платежа на срок от 5 до 90 дней. Условия отсрочки платежа рассматриваются индивидуально. Подробную информацию уточняйте у вашего менеджера.

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Описание

NVIDIA H800 SXM5 — это тензорный GPU-ускоритель дата-центрового класса на архитектуре NVIDIA Hopper, разработанный для обучения и инференса крупных языковых моделей (LLM), глубокого обучения, высокопроизводительных вычислений (HPC) и масштабируемых AI‑нагрузок в составе серверных платформ с модульным форм‑фактором SXM пятого поколения. В официальном даташите NVIDIA H800 Tensor Core GPU и аналитических спецификациях указывается, что H800 SXM5 основан на кристалле GH100, содержит 16 896 ядер CUDA, 528 тензорных ядер и 80 ГБ памяти HBM3 с пропускной способностью до 3,36 ТБ/с. Ускоритель использует архитектуру Hopper с поддержкой форматов FP8, FP16, TF32, FP32 и FP64, а также Transformer Engine, что позволяет существенно ускорять обучение и инференс трансформерных моделей по сравнению с предыдущим поколением. Пиковая производительность для варианта H800 SXM5 оценивается примерно в 59,3 TFLOPS в FP32, около 237 TFLOPS в FP16 и порядка 29,7 TFLOPS в FP64, согласно сводным спецификациям. Типичное энергопотребление модуля в исполнении SXM5 достигает 700 Вт, что предполагает использование специализированных серверных платформ с поддержкой SXM5 и продуманной системой питания и охлаждения.

Архитектура и ключевые характеристики

Согласно официальному даташиту NVIDIA H800 Tensor Core GPU, ускоритель H800 построен на архитектуре Hopper и использует графический процессор GH100, изготовленный по 4‑нм техпроцессу TSMC с примерно 80 млрд транзисторов. В аналитических спецификациях для H800 SXM5 указывается, что конфигурация включает 132 вычислительных блока (SM), что даёт суммарно 16 896 ядер CUDA, 528 тензорных ядер и 528 текстурных блоков, а также 24 блока растеризации. Базовая частота ядра составляет около 1 095 МГц, boost‑частота — до 1 755 МГц, что в совокупности обеспечивает пиковую производительность порядка 59,3 TFLOPS в FP32, 237,2 TFLOPS в FP16 и почти 29,7 TFLOPS в FP64. В архитектуру Hopper заложены механизмы ускорения трансформеров (Transformer Engine), позволяющие автоматически управлять смешанной точностью (FP8/FP16) и достигать существенно более высокой производительности при обучении LLM‑моделей.

Подсистема памяти NVIDIA H800 SXM5 представлена 80 ГБ HBM3 с 5 120‑битной шиной и эффективной пропускной способностью около 3 360 ГБ/с, что зафиксировано в спецификациях H800 SXM5. В официальном даташите NVIDIA H800 Tensor Core GPU указывается поддержка ECC для HBM‑памяти, обеспечивающей обнаружение и коррекцию ошибок, а также использование кеша L2 объёмом 50 МБ, что снижает задержки при доступе к данным. Форм‑фактор SXM5 подразумевает установку ускорителя непосредственно на серверную плату через модульный разъём; интерфейс связи с хост‑системой реализован через PCIe 5.0 x16, а межсоединения между GPU обеспечиваются NVLink последнего поколения. В аналитических данных для H800 SXM5 отмечается, что поддерживаются до 7 NVDEC и 7 JPEG‑ускорителей, что важно для мультимедийных и видеоаналитических задач.

Типичное энергопотребление H800 SXM5 оценивается в 700 Вт TDP, а рекомендуемая мощность блока питания для одного GPU — не менее 1 200 Вт, что отражено в спецификациях. Это требует использования серверных шасси, специально рассчитанных на размещение нескольких SXM5‑модулей и на достаточную теплоотдачу. В документации NVIDIA для H800 подчёркивается поддержка технологий Multi‑Instance GPU (MIG), позволяющих разделять один физический GPU на несколько независимых логических экземпляров, а также наличие до 7 NVDEC‑блоков и ускорителей JPEG, ориентированных на обработку видео и изображений. В совокупности архитектура Hopper, 16 896 CUDA‑ядер, 528 тензорных ядер, 80 ГБ HBM3 и высокая полоса памяти делают H800 SXM5 одним из ключевых ускорителей для крупномасштабных AI‑и HPC‑нагрузок.

Сценарии применения

В официальном даташите NVIDIA H800 Tensor Core GPU и аналитических обзорах H800 SXM5 позиционируется как специализированный ускоритель для задач генеративного ИИ, крупных языковых моделей, глубокого обучения и научных вычислений, где критичны производительность и пропускная способность памяти. Архитектура Hopper с Transformer Engine, поддержка FP8/FP16 и 80 ГБ HBM3 позволяют использовать H800 SXM5 в самых ресурсоёмких AI‑проектах и HPC‑сценариях.

- Идеально подходит для обучения нейросетей (Deep Learning), в первую очередь крупных трансформерных моделей и LLM, где используются форматы FP8/FP16, требуется высокая полоса памяти (до 3,36 ТБ/с) и большая ёмкость HBM3 для размещения параметров модели и больших батчей.

- Предназначен для инференса LLM моделей и других задач обработки естественного языка (NLP), где применяются оптимизированные и квантованные модели, а тензорные ядра Hopper обеспечивают низкую задержку и высокую производительность при обработке большого числа параллельных запросов в пределах кластера из нескольких H800 SXM5.

- Ориентирован на высокопроизводительные вычисления (HPC): численное моделирование, методы конечных элементов, моделирование материалов, квантовую химию и CFD, где используются форматы FP64/FP32 и важно сочетание 29,7 TFLOPS в FP64 с высокой пропускной способностью HBM3.

- Эффективен в задачах аналитики данных и машинного обучения (ML), включающих рекомендательные системы, анализ логов, графовые модели и статистические расчёты, где GPU ускоряет матричные операции и алгоритмы оптимизации по сравнению с CPU‑только решениями.

- Подходит для видеоаналитики и комплексной обработки мультимедиа, где присутствует множество потоков видео и изображений, и используются до 7 NVDEC и 7 JPEG‑ускорителей, а также тензорные ядра для применения моделей компьютерного зрения.

- Применяется в гибридных кластерных и облачных инфраструктурах для задач генеративного ИИ и мульти‑арендных сред, где благодаря MIG один H800 SXM5 можно разделить между несколькими пользователями или сервисами без потери изоляции и управляемости.

Совместимость

NVIDIA H800 SXM5 — это модуль в форм‑факторе SXM5, предназначенный для установки на специализированные серверные платы, поддерживающие GPU‑модули Hopper‑поколения, и использующий для связи с хостом интерфейс PCIe 5.0 x16 и NVLink для межGPU‑взаимодействия. Для корректной работы требуются серверные платформы с поддержкой SXM5, соответствующим питанием (до 700 Вт на модуль) и продуманной системой охлаждения, рассчитанной на высокую тепловую нагрузку.

- Ускоритель протестирован на совместимость с серверными платформами: Dell PowerEdge, о чём свидетельствуют отраслевые обзоры и сравнительные гиды по GPU‑серверам, где рассматриваются PowerEdge‑системы с поддержкой современных SXM‑модулей на базе архитектуры Hopper, к которым относится и H800 SXM5.

- Поддерживается в системах HPE ProLiant и специализированных решениях HPE для GPU‑нагрузок, где в документации о GPU‑серверах и dHCI‑решениях указываются платформы с поддержкой SXM‑модулей Hopper‑класса, аналогичных H800 SXM5 по требованиям к питанию и охлаждению.

- Совместим с серверными платформами Supermicro, ориентированными на GPU‑вычисления, где в сравнительных гайдах по GPU‑серверам Supermicro упоминается поддержка SXM‑узлов и NVLink‑конфигураций для современных ускорителей на архитектуре Hopper (H100/H800‑класса).

- Может использоваться и в других OEM‑системах, которые поддерживают модульный форм‑фактор SXM5, интерфейсы PCIe 5.0 x16 и NVLink, обеспечивают до 700 Вт на модуль и необходимый воздушный или жидкостный контур охлаждения, как указано в даташите NVIDIA H800 Tensor Core GPU и аналитических спецификациях.

Надёжность и эксплуатация в ЦОД

В официальном даташите NVIDIA H800 Tensor Core GPU подчёркивается, что ускоритель предназначен для круглосуточной эксплуатации в крупномасштабных центрах обработки данных, где критичны стабильность, предсказуемое энергопотребление и эффективность на ватт. Высокий TDP (до 700 Вт) и форм‑фактор SXM5 требуют использования специализированных серверов с тщательно спроектированными системами охлаждения (воздушного или жидкостного), а также соответствующей инфраструктуры питания, что отражено в рекомендациях по развертыванию. Поддержка ECC для HBM3, механизмов контроля ошибок и технологий MIG повышает надёжность и позволяет безопасно консолидировать множество рабочих нагрузок на одном GPU, минимизируя риск взаимного влияния.

Документация NVIDIA AI Enterprise и vGPU указывает на поддержку профилей виртуальных GPU для H800‑класса, что делает возможным эффективное разделение акселератора между несколькими виртуальными машинами и контейнерами, сохраняя аппаратное ускорение для каждого из них. В сочетании с квалифицированными GPU‑серверами Dell, HPE, Supermicro и другими OEM‑платформами, рассчитанными на Hopper‑поколение, это упрощает развёртывание кластеров для обучения нейросетей, инференса LLM и HPC‑нагрузок. Архитектура Hopper, 16 896 CUDA‑ядер, 528 тензорных ядер, 80 ГБ HBM3 с пропускной способностью 3,36 ТБ/с и форм‑фактор SXM5 делают NVIDIA H800 SXM5 надёжной и высокопроизводительной основой для современных инфраструктур ИИ и высокопроизводительных вычислений в крупных центрах обработки данных.

подбор оборудования

до 90 дней