Внимание

Мы работаем в штатном режиме. Наши склады готовы поставлять оборудование клиентам из Российской Федерации несмотря на санкционные запреты ЕС и США. Оборудование в РФ ввозится легально благодаря новому законодательству с параллельным импортом. Звоните и уточняйте! Информация актуальна на 27.02.26В связи с участившимися случаями недобросовестной конкуренции обращаем ваше внимание, что мы не передаем персональные данные третьим лицам

Поиск по сайту

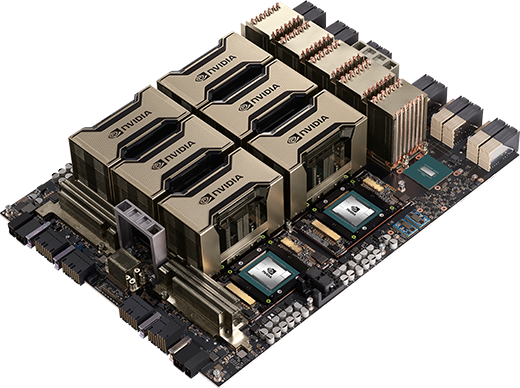

Платформа NVIDIA HGX B200

Почему нет цен?

Уточнить ценуГарантия до 5 лет

Диагностика перед отправкой

С нами выгодно и удобно!

- Поддержка персонального менеджера

- Партнёрские скидки до 70%

- Онлайн-кабинет гарантийного сервиса

Как купить?

Раз, два и все делаРассчитаем стоимость

Присылайте спецификацию для подбора и расчета стоимости оборудования

Привезём и подключим

Подключим и настроим оборудование в вашем офисе или ЦОДе

Характеристики

Совместимость

Лицензии

Отсрочка платежа

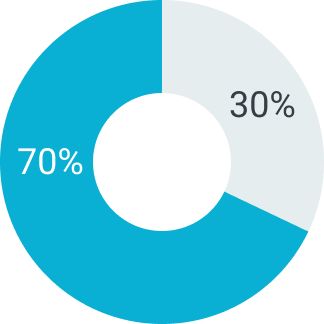

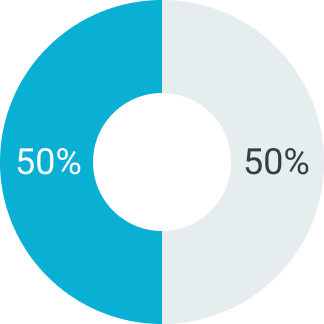

В зависимости от суммы поставляемого товара можем предоставить отсрочку платежа на срок от 5 до 90 дней. Условия отсрочки платежа рассматриваются индивидуально. Подробную информацию уточняйте у вашего менеджера.

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Первый платеж

Второй платеж

Описание

HGX B200 8-GPU (w/ Heatsink) NVIDIA 24576 7.7TB/s 180GB 9335W

NVIDIA HGX B200 — это серверная платформа нового поколения на базе GPU NVIDIA Blackwell B200, созданная специально для обучения и инференса крупнейших моделей искусственного интеллекта, сложных задач глубокого обучения и высокопроизводительных вычислений в дата‑центрах. Узел HGX B200 интегрирует до восьми GPU B200 в единую высокоскоростную вычислительную матрицу с использованием межсоединений NVIDIA NVLink и NVSwitch пятого поколения, обеспечивающих обмен данными между GPU с пропускной способностью на уровне терабайт в секунду. Каждый GPU B200 оснащён памятью HBM3e большого объёма (до 192 ГБ на один ускоритель), а суммарный объём быстрой памяти в узле 8‑GPU достигает порядка 1,4 ТБ с совокупной пропускной способностью в десятки терабайт в секунду, что делает возможной работу с моделями масштаба сотен миллиардов параметров. Платформа HGX B200 служит базой для серверов ведущих производителей и используется как строительный блок для кластеров генеративного ИИ, систем анализа больших данных, высоконагруженного инференса и смешанных AI/HPC‑нагрузок в облачных и корпоративных инфраструктурах. При проектировании HGX B200 особое внимание уделено энергоэффективности и снижению совокупного углеродного следа на единицу производительности по сравнению с предыдущими поколениями, что подтверждается данными отчёта по углеродному следу продукта (PCF).

Архитектура и ключевые характеристики

В основе NVIDIA HGX B200 лежат GPU семейства Blackwell B200, объединившие в себе специализированные блоки для ускорения вычислений ИИ, высокоточной математики и работы с большими языковыми моделями. Каждый ускоритель в составе узла HGX B200 оснащается памятью HBM3e высокой ёмкости и пропускной способности, при этом общий объём памяти конфигурации 8‑GPU достигает порядка 1,4 ТБ, что критично для размещения и обслуживания очень крупных моделей без постоянного обмена с внешними системами хранения. Использование NVLink и NVSwitch пятого поколения обеспечивает плотную связность между GPU с межпроцессорной пропускной способностью на уровне до 1,8 ТБ/с на один GPU и совокупным межсоединением порядка 14,4 ТБ/с на узел 8‑GPU, минимизируя задержки и повышая эффективность распределённого обучения.

Платформа HGX B200 спроектирована как модульный вычислительный блок для интеграции в серверные системы формата 4U и более высокой плотности, с поддержкой до восьми GPU в составе одного узла и возможностью масштабирования до кластеров из сотен и тысяч GPU. Конструктив предусматривает оптимизированные тракты воздушного или жидкостного охлаждения, развитую систему питания и разводку высокоскоростных линий, что позволяет поддерживать стабильную работу GPU Blackwell B200 при высоких тепловых пакетах и круглосуточной нагрузке. Платформа интегрируется с современными CPU‑архитектурами и сетевой инфраструктурой на базе высокоскоростных интерфейсов (InfiniBand, Ethernet с поддержкой RoCE), обеспечивая полноценную работу в составе кластеров для задач генеративного ИИ и HPC.

HGX B200 поддерживает программный стек NVIDIA для дата‑центров, включая CUDA, библиотеки CUDA‑X, средства оркестрации и управления ресурсами, а также программные решения для построения и эксплуатации генеративных AI‑платформ. Это позволяет использовать платформу в составе как собственных инфраструктур операторов ЦОД, так и в публичных и приватных облаках, где предъявляются высокие требования к масштабируемости, изоляции ресурсов и эффективности использования оборудования.

Сценарии применения

Набор аппаратных возможностей NVIDIA HGX B200 и её интеграция в серверные решения делают платформу ключевым элементом современных инфраструктур для задач искусственного интеллекта и высокопроизводительных вычислений.

- Идеально подходит для обучения нейросетей (Deep Learning) крупного масштаба, включая трансформерные архитектуры и модели с сотнями миллиардов параметров, где необходимы большой объём HBM‑памяти и высокоскоростные межсоединения между GPU.

- Оптимизирована для инференса LLM моделей и генеративных AI‑сервисов (chat‑боты, системы генерации текста, кода, изображений и мультимодальные модели), требующих высокой пропускной способности по запросам и минимальной задержки при обслуживании большого числа пользователей.

- Предназначена для высокопроизводительных вычислений (HPC): численное моделирование, методы Монте‑Карло, климатическое моделирование, задачи вычислительной гидродинамики и структурного анализа, где критична производительность операций с плавающей точкой и масштабирование на большое число ускорителей.

- Подходит для построения кластеров генеративного ИИ и RAG‑систем (retrieval‑augmented generation), где требуется тесная интеграция вычислительных ресурсов с системами хранения и высокоскоростными сетями для обработки больших корпусов данных и индексов.

- Используется в корпоративных и облачных платформах как основа для предоставления GPU‑ресурсов «как услуги», включая сценарии multi‑tenant, виртуализацию рабочих нагрузок и гибкое масштабирование вычислительных мощностей под потребности заказчиков.

Совместимость

NVIDIA HGX B200 разрабатывается как референсная платформа для OEM‑партнёров и интеграторов, на основе которой создаются готовые серверы с поддержкой восьми GPU Blackwell B200 и соответствующей инфраструктурой питания и охлаждения. Ускоритель протестирован на совместимость с серверными платформами и решениями ведущих производителей, которые предлагают конфигурации на базе HGX B200 для центров обработки данных, ориентированных на ИИ и HPC.

- Dell PowerEdge и другие серверные линейки, для которых доступны конфигурации на базе платформ HGX (включая поколение B200) в рамках программ NVIDIA‑Certified Systems, предназначенные для развёртывания кластеров генеративного ИИ и HPC‑нагрузок.

- HPE ProLiant и специализированные GPU‑серверы HPE, поддерживающие узлы HGX и ориентированные на высокоплотные конфигурации с несколькими GPU, применяемые в задачах обучения и инференса больших моделей и инженерных вычислений.

- Supermicro серверные системы на базе HGX B200, включая решения с фронтальным и стандартным вводом‑выводом, для которых опубликованы отдельные технические описания и спецификации с указанием поддерживаемых конфигураций CPU, памяти, сетевых адаптеров и хранилищ.

Платформа HGX B200 интегрируется в инфраструктуры, соответствующие требованиям к питанию, охлаждению и пространству для размещения высокоплотных GPU‑узлов, а также в архитектуры с высокоскоростной сетью (InfiniBand и Ethernet), необходимой для построения масштабируемых кластеров. Совместимость и рекомендуемые конфигурации фиксируются в документации программ NVIDIA‑Certified Systems и материалах OEM‑партнёров, что упрощает выбор оптимальных серверов и компонентов для построения комплексов на базе HGX B200.

Энергоэффективность и устойчивость

При разработке NVIDIA HGX B200 значительное внимание уделено энергоэффективности и снижению углеродного следа в расчёте на единицу производительности, что особенно важно для дата‑центров, эксплуатирующих крупные GPU‑кластеры. По данным сводного отчёта о продукте (Product Carbon Footprint), платформа демонстрирует уменьшение интенсивности «встроенных» выбросов углерода по сравнению с предыдущими поколениями HGX при существенном росте производительности, что позволяет операторам ЦОД реализовывать стратегии устойчивого развития и «зелёных» ИТ. Оптимизированная конструкция платформы, использование современных технологических процессов при производстве GPU и поддержка режимов энергосбережения на уровне программного стека помогают снижать суммарное энергопотребление при сохранении требуемого уровня производительности.

HGX B200 полностью интегрируется в программную экосистему NVIDIA для центров обработки данных, включая инструменты мониторинга, управления питанием и телеметрии, что даёт администраторам возможность детально контролировать энергоэффективность и загрузку ресурсов кластера. В сочетании с сертифицированными серверными платформами и современными сетевыми решениями это делает NVIDIA HGX B200 фундаментом для построения высокопроизводительных и одновременно устойчивых инфраструктур генеративного ИИ и HPC в крупных корпоративных и облачных средах.

подбор оборудования

до 90 дней